大脑的结构和功能十分复杂, 其病变通常会导致神经性退行疾病的产生。神经元作为大脑结构的基本单位, 其结构和功能包含着很多因素, 其中形态特征和电学特性是2个非常重要的因素[1]。神经元形态分类是探索和理解大脑神经功能的基本途径, 广泛应用于神经元形态的三维重建、神经功能和结构映射等研究领域[2-4]。神经元形态与其功能息息相关, 因此依据神经元的形态特征对神经元进行分类, 非常有助于理解大脑的结构和功能。但神经元具有复杂多样的形态结构, 不同类型神经元之间的区别性小, 而同类型神经元的子类和结构的区别性大, 因而容易导致神经元形态分类准确率不高的问题。传统的神经元形态分类, 主要依赖于手动提取特征, 不仅费时费力, 而且分类准确率不理想。

近年来, 深度学习在图像分类中表现优异, 逐渐成为研究图像分类的主流方法。深度卷积神经网络虽然在神经元形态分类领域展现出不错的前景, 但其性能远未达到预期。因为在卷积过程中, 若是一味地遵循卷积工作模式, 随着网络深度不断加深, 将会丢失边缘像素信息, 不利于神经元形态特征的提取。Hinton等[5]为了解决感知偏差提出填充策略, 该策略允许在输入图像的外围使用零填充再开始卷积, 这为边缘像素与卷积核交互提供了更多的机会, 从而抑制了卷积的感知偏差, 增加了边缘信息对特征提取的贡献。同时, 填充策略可以防止输入图像在卷积后出现特征收缩现象, 在一定程度上提高了卷积神经网络的性能。但在图像处理领域中, 每个像素都有它的实际意义, 零填充会带来新的数据并将其合并到图像中, 大量外来像素会逐层侵蚀特征信息, 从而导致神经元分类性能受到影响[6]。

为了解决上述问题, 本文深入研究卷积神经网络的架构和神经元形态数据, 以残差网络(residual network, ResNet)[7]为基础网络, 提出了一种基于特征重构自愈残差网络(feature reconstruction self-cure residual network, FRSRN)用于实现神经元形态分类任务。具体流程为: 在基础网络的后端搭建特征重构模块, 该模块通过亚像素卷积[8]对特征进行重组, 获得更大的特征图。使用大步幅的卷积核对特征图进行二次提取以提高边缘像素的感知频率, 从而缓解神经元的形态特征在提取阶段因填充策略而导致的特征被外来像素侵蚀的问题。融合自注意力权重和排序正则化模块, 通过自注意力权重模块为每一个样本重新分配权重, 排序正则化模块对自注意力权重模块学习到的权重进行降序以此确保学习到有意义的权重, 促使网络更加关注神经元几何形态特征和有效地提取神经元形态分类判别性特征, 从而获得更加准确的神经元形态分类结果。

1 相关研究工作早期, Wang等[9]根据原始空间几何数据估计神经元形态特征, 提出了一种新的基于支持向量机(support vector machine, SVM)的神经元形态分类方法。Alavi等[10]分析了多个维度的神经元图像, 并使用结构特征提取技术获取其显著特征, 实现了对啮齿动物脑干中的多巴胺能神经元进行自动化分类。Vasques等[11]使用L-measure提取形态学特征, 并分别将无监督和监督分类技术应用于形态学特征分类。Fogo等[12]使用机器学习技术对线粒体形态进行计算图像分析, 可以对不同的生理和病理线粒体形态进行准确分类。

近年来, 深度学习方法成为数字图像处理的主流方法, 与传统机器学习方法不同, 深度学习可以更深层次地提取神经元的形态特征, 并实现自动分类, 因此更加受到研究者的青睐。Lin等[13]分别构建了线虫和斑马鱼2种不同物种的神经元数据集, 在此基础上提出了局部累加连接深度神经网络的神经元形态分类方法, 将神经元的几何形态量化特征作为网络的输入来进行神经元形态分类。文献[14]基于自适应投影算法将三维神经元图像投影成二维图像, 并针对该数据提出了双卷积门限循环神经网络模型。文献[15]使用了完整的神经元三维体素数据进行缩放, 采用三维卷积神经网络进行神经元几何形态的分类实验。Zhang等[16]提出了采用不同类型的深度神经网络模块可以很好地处理不同类型的特征, 首先针对神经元图像数据构建了一个卷积神经网络(CNN)模块, 然后针对压缩但非结构化的SWC格式数据构建了一个Tree-RNN模块, 最后将这2个模块提取到的特征融合后再进行分类。Yamashiro等[17]对大鼠初级体感皮层(S1)和初级运动皮层(M2)中的神经元进行免疫组织化学染色, 并借助深度学习算法对Nissl和NeuN免疫信号进行二分类。与上述方法不同的是, 本文提出的方法是在解决传统卷积缺陷的基础上进行改进, 并通过融合多个子网络模块来关注网络感兴趣的区域, 从而达到较好的神经元形态分类性能。

本文以Zhang等[16]制作的大鼠神经元形态数据集作为实验基础, 分别在3个神经元图像数据集上进行二分类和十二分类实验, 以此来验证本文方法的有效性。

2 方法神经元形态分类算法一般分为预处理、特征提取、神经元特征分类。面对具有复杂多样结构的神经元, 对每个像素信息的提取都极为重要。在卷积神经网络中, 填充策略可以缓解特征图收缩和卷积过程中存在的感知偏差, 但同时会引入新的特征, 受Shi等[18]提出的去白化模块(de-albino block)消除白化特征的启发, 结合神经元形态数据的特点, 提出基于特征重构自愈残差网络(FRSRN)。本节将概述FRSRN, 再详细介绍每个模块的功能。

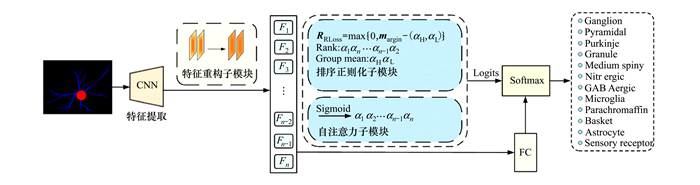

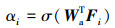

2.1 总体框架本文提出的FRSRN采用ResNet-18作为前端基础网络进行特征提取, 为了解决卷积填充带来的问题, 在基础网络后端构建了特征重构模块, 该模块是由亚像素卷积对已提取到的特征图进行重组, 获得2个通道的特征图, 再进行二次处理得到更加准确和干净的特征, 从而更有利于神经元形态分类。同时, 为了更好地让网络关注有效的神经元形态特征, 使用自注意力权重模块, 为每个样本重新分配权重, 并在网络训练时引入了排序正则化损失函数。

如图 1所示, FRSRN主要由3个模块组成: 特征重构模块、自注意力权重模块以及作为辅助的排序正则化模块。特征重构模块将基础网络提取到的特征重新分配并进行二次提取。自注意力权重模块进一步对样本进行权重重新分配, 并使用排序正则化模块对权重进行排序, 从而促进网络关注到更加有效的神经元形态特征。

|

| 图 1 特征重构自愈残差网络 |

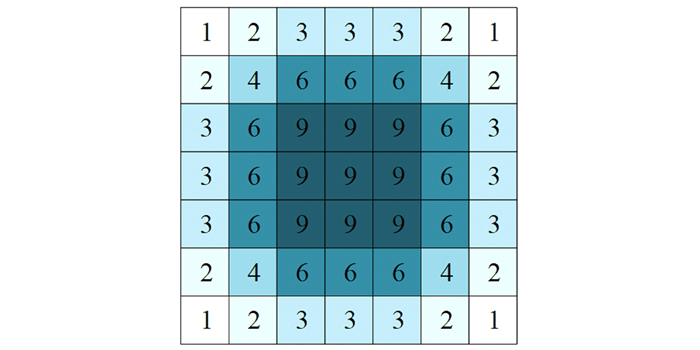

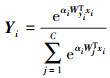

传统卷积神经网络在卷积过程中会出现感知偏差, 即图像边缘像素与卷积核交互的频率少于中间像素与卷积核交互的频率。本文使用7×7的矩阵来表示图像的像素感知频率, 如图 2所示, 通过步幅为1, 大小为3的卷积核在7×7的特征图上进行卷积, 图中的数字表示卷积交互的次数, 由此可知在卷积核进行卷积的过程中, 边缘像素的感知频率要低于中间像素的感知频率。随着网络层数的加深, 容易丢失边缘的重要信息, 非常不利于神经元形态分类。因此, 有研究者提出使用填充策略来缓解边缘信息丢失的问题[5]。而引入填充策略会带来新的问题, 如使用零填充策略在卷积过程中零元素伴随卷积操作流入新特征, 造成原始特征被侵蚀的问题。

|

| 图 2 感知偏差示意图 |

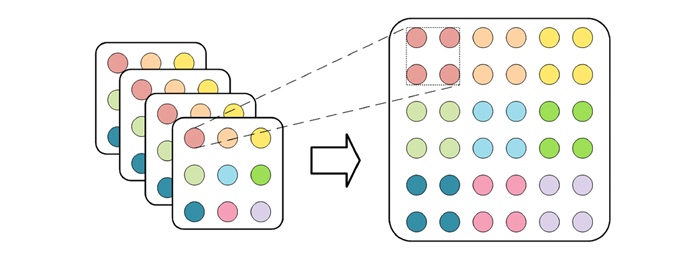

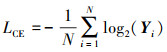

考虑到感知偏差和填充策略侵蚀特征都出现在图像边缘位置, 如果能将受侵蚀程度相同的像素聚集在一起, 同时保持它们的相对位置分布, 再对其进行二次处理, 便可缓解在提取过程中出现特征丢失和侵蚀的问题。亚像素卷积[8]可以将通道信息转换为空间信息,同时还可以保存像素之间的相对位置。因此, 本文在特征重构模块中首先采用亚像素卷积进行特征重新分配, 其具体实施过程如图 3所示, 将每个特征图相对应的位置像素点聚集以获取更大的特征图, 其中相对应位置像素点的聚集称为特征簇。

|

| 图 3 特征重新分配示例图 |

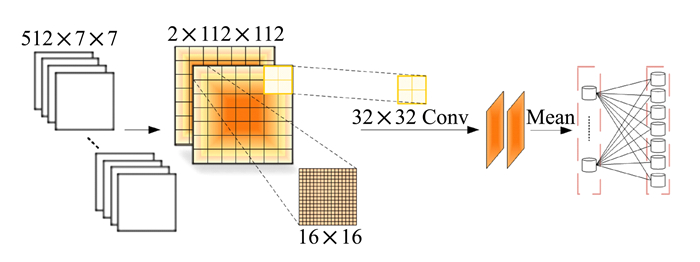

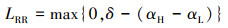

为了更好地实现神经元分类, 在基础网络的后端, 构建特征重构模块以提取更为干净的形态特征, 其结构如图 4所示。

|

| 图 4 特征重构模块 |

通过ResNet-18提取512个通道的7×7特征图, 使用亚像素卷积对特征图进行重构,得到2个通道的112×112特征图, 其中特征簇大小为16×16。卷积核的大小和步幅都会影响感知偏差, 因此通过调整卷积核的大小重新将权重定性分配给不同位置的像素, 同时考虑2个通道的相关性, 获得重构后的特征图进行特征提取的卷积核必须为单通道且大于特征簇, 这样才能增强特征的多样性, 确保在特征提取过程中卷积核发挥作用。同时卷积核的步幅设置为8, 为特征簇大小的一半。特征重构模块的输出将2个通道的特征均值化, 分别代表了每个神经元的特征。

2.3 自注意力权重模块自注意力权重模块(self-attention weight model)受启发于文献[19], 通过自注意力权重模块为每个样本学习一个权重, 以此捕获对样本的学习, 该模块由线性全连接层(fully connected layers, FC)和sigmoid函数组成。在预测神经元的样本中, 会存在较高或较低的权重, 因此, 在改进的网络中, 引入自注意力权重模块为神经元样本重新分配权重, 在神经元形态特征中学习样本权重从而进行损失加权。将F=[F1, F2, …, Fn]∈RH×W×C作为输入, 并输出每个特征权重为

|

(1) |

式中:αi表示第i个样本的权重;Wa表示网络关注FC层的参数;σ为sigmoid函数。

2.4 排序正则化模块由于神经元存在结构的相似性和复杂的多样性, 增强网络对神经元形态特征的学习尤为重要。受文献[19-20]的启发, 采用2个简单的损失函数的线性组合来收敛网络训练。首先, 对于N个神经元类别, 网络输出N维向量, 通过自注意力权重将输出结果归一化至[0, 1]之间, 设Wj表示的是第j个分类器, Yi表示第i个样本中被分为i类的概率, 则有

|

(2) |

本文采用对数加权的方法, 对于多分类任务, 对数加权交叉熵损失函数定义为

|

(3) |

并对自注意力权重模块学习到的注意力权重使用辅助模块即排序正则化模块(rank regularization module), 该模块对学习到的注意力权重进行降序排列, 然后以一定的比率β权重分为高低2组权重。

|

(4) |

式中:

|

(5) |

式中:LRR表示排序正则化损失函数;LCE表示多分类交叉熵损失函数。

3 实验结果与分析 3.1 实验数据集本文实验均在NeuroMorpho-rat数据集[16]中的神经元二维图像数据集上进行, 其中包含爬虫获得的原始神经元图像(Img_raw)、软件修复后生成的神经元图像(Img_resample)和把XY对齐后的神经元图像数据(Img_XYalign), 相关参数如表 1所示。

| 分类类型 | 数据集 | 原始分辨率 | 训练集分辨率 | 训练集数量 | 测试集数量 |

| 二分类 | Img_raw Img_resample Img_XYalign |

640×500 1 167×875 1 167×875 |

224×224 224×224 224×224 |

24 448 22 493 23 530 |

4 945 4 567 4 766 |

| 十二分类 | Img_raw Img_resample Img_XYalign |

640×500 1 167×875 1 167×875 |

224×224 224×224 224×224 |

16 885 15 425 16 239 |

3 421 3 163 3 313 |

本文分别对这3个神经元形态数据集进行二分类和十二分类实验。二分类的神经元类型包含主神经元(principal cell)和中间神经元(iterneuron), 十二分类是由6种主神经元(principal cell)、3种中间神经元(iterneuron)、2种胶质神经元(glia)和1种感受体神经元(sesensor receptor)的12个子类组成, 其中主细胞神经元(principal)包含Ganglion、Granule、Medium spiny、Parachromaffin、Purkinjie和Pyramidal神经元, 中间神经元(iterneuron)包含Basket、GABAergic和Nitrergic神经元, 胶质神经元(glia)包含Microglia和Astrocyte神经元。

3.2 实验设置本文实验是基于深度学习框架PyTorch1.10和解释器Python3.7实现的, 硬件配置是Intel Xeon Silver 4110 CPU 2.1 GHz、128 GB RAM以及NVIDIA RTX3090 24GB GPU, 加速库为CUDA 11.3。由于数据集的数量、分辨率有所差异, 在对网络进行训练之前先对数据集进行预处理。将所有输入图像裁剪为224×224, 3个数据集上的图像批处理大小设置为64。训练过程中使用SGD优化器对损失函数进行优化, 初始学习率为10-3, 权重衰减系数为10-4, γ系数为0.9。

首先, 为了验证本文网络模型的有效性, 在选定基础网络模型后, 将本文提出的方法分别在3个神经元形态数据集上进行验证, 对训练好的模型用测试集进行测试, 生成相应的混淆矩阵, 并对神经元形态分类效果进行分析。同时也比较了一些经典的分类方法。然后, 为了验证各个模块对神经元形态分类的有效性而进行了相应的消融实验。最后, 使用t-SNE[21]分析高维特征的分布情况。

3.3 基础网络的选取一般应用于图像分类的深度学习网络中最常见的分类模型是VGG[21]和ResNet[7]。因此, 在Img_resample数据集上进行十二分类任务, 验证深度不同网络的神经元形态分类性能, 通过评估网络模型的参数量和分类的准确率来确定基础网络,如表 2所示。

| 基础网络 | 参数量M | 分类准确率/% |

| VGG13 | 9.41 | 81.95 |

| VGG16 | 14.73 | 79.45 |

| VGG19 | 20.04 | 80.08 |

| ResNet18 | 11.18 | 84.38 |

| ResNet34 | 21.29 | 84.82 |

| ResNet50 | 23.53 | 84.74 |

| ResNet101 | 42.52 | 84.27 |

| ResNet152 | 58.17 | 84.57 |

实验中使用到的超参数与本文提出的方法一致, 输入图像均调整为224×224大小, 并且均使用交叉熵损失的策略来训练网络。由表 2可以看出, ResNet系列的整体准确率都优于VGG系列。因此从模型参数量和准确率这2个角度综合考虑, ResNet18可以以较少的参数量获得较高的分类准确率, 这表明了ResNet18网络模型更适合作为神经元形态分类的前端特征提取器。

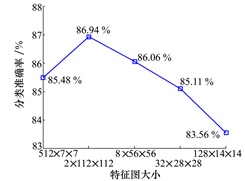

3.4 消融实验首先, 为了验证特征重构模块设计的合理性, 在Img_resample数据集上进行对比实验确定特征重构模块的相关参数, 具体实施: 在整体网络框架(见图 1)的特征重构模块上将ResNet18提取到的特征图重组成大小不同的特征图进行对比实验。如图 5所示, 分别将基础网络提取到512×7×7的特征图重组为2×112×112, 8×56×56, 32×28×28和128×14×14进行实验, 其中纵坐标为分类准确率, 横坐标是特征重组后对应的特征图大小, 512×7×7代表不使用特征重构模块。从折线图中可以看出, 特征图被重新组合成2×112×112的分类准确率最高, 达到了86.94%;其次特征图重组成8×56×56的准确率为86.06%, 而另外2个组合的分类效果明显下降, 甚至低于未加入特征重构模块的分类效果。实验结果表明, 在特征重构模块中, 将基础网络提取到的特征重组为2个通道的大特征图适用于神经元形态分类任务。

|

| 图 5 特征图重构实验对比 |

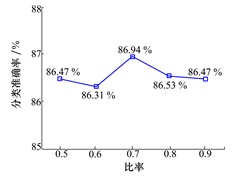

其次, 在Img_resample数据集上对排序正则化模块的比率和裕度参数进行实验评估。β作为高权重样本组的比率, 在实验中对β为0.5~0.9进行实验对比, 实验结果如图 6所示。当比率为0.7时, 分类性能达到最佳, β过大, 会降低整体网络性能, β过小, 会减少训练的损失, 不利于学习神经元形态特征。

|

| 图 6 高低权重比率评估 |

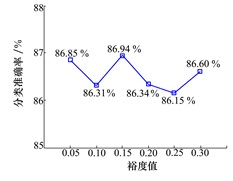

同时, 评估了用于控制高低2组权重的参数裕度δ, 如图 7所示。实验结果表明, 裕度值为0.15时, 分类性能较好。

|

| 图 7 可学习的裕度δ评估 |

通过上述实验, 确定了基础网络为ResNet18, 特征重构模块由亚像素卷积重构特征图, 获得2个通道的大特征图并使用大卷积核进行二次处理, 同时引入自注意力权重模块和排序正则化模块, 其中, 排序正则化模块将学习到的权重以7∶3的比例分为高权重组和低权重组。表 3列出了本文提出网络模型的详细信息。本文以ResNet18作为前端特征提取网络, 保留了全局平均池化层(global average pool)之前的网络层(ResNet18*), 并使用在ImageNet上的预训练权重进行初始化。通过基础网络提取到大小为512×7×7的特征图, 使用亚像素卷积将特征重新组合, 重组后的特征通道由512个通道减少为2个通道, 特征图大小增加到112×112, 经过此操作获得更大的特征图, 利于后续二次特征提取, 缓解特征弱化问题。此外, 本文还引入了自注意力权重模块, 促进网络更好地关注有判别性的神经元形态特征。

| 网络类型 | 输出 | 超参数 | 参数数量 |

| ResNet18* | [None, 512, 7, 7] | 无需调整 | 11 178 395 |

| Reorganization | [None, 2, 112, 112] | 0 | |

| FRM | [None, 2, 11, 11] | C=1, k=32, s=8, p=0 | 1 024 |

| BN | [None, 2, 11, 11] | 4 | |

| Mean | [None, 11, 11] | 0 | |

| weight | [None, 11, 11] | 0 | |

| FC | [None, 12] | 每层121个神经元,12个神经元输出 | 1 464 |

最后, 为了评估本文提出网络中各个模块的有效性, 以在ImageNet数据集上预训练的ResNet18为基础网络, 在Img_raw、Img_resample和Img_XYalign 3个神经元形态数据集上进行消融实验。具体实施: 以ResNet18为基础网络, 再逐步加入特征重构模块(FRM), 自注意力权重模块(weight)和排序正则化模块(RRM), 并在3个数据集上分别进行实验验证, 比较最终的分类准确率。其中, 每个数据集上都分别进行了二分类和十二分类实验。从表 4的消融实验结果上看, 分别融合3个模块的网络均能在基础网络上提升神经元形态分类的准确率。在基础网络上引入特征重构模块, 结果显示3个数据集上的分类准确率分别提高了7.51%, 0.11%, 1.24%, 说明特征重构模块能够有效缓解边缘信息丢失的问题。在此基础上, 加入自注意力权重模块, 使网络能够更加关注到具有判别性的神经元形态特征, 神经元识别率得到提升。改进后的网络模型在3个数据集上进行二分类实验, 分别达到了95.19%, 87.67%, 87.18%的分类准确率。

| FRM | weight | RRM | 分类准确率/% | ||

| Img_raw | Img_resample | Img_XYalign | |||

| × | × | × | 86.81 | 85.26 | 85.50 |

| √ | × | × | 94.32 | 85.37 | 86.74 |

| × | √ | × | 93.14 | 84.26 | 85.93 |

| × | √ | √ | 94.82 | 86.75 | 85.34 |

| √ | √ | × | 94.44 | 86.58 | 86.95 |

| √ | √ | √ | 95.19 | 87.67 | 87.18 |

表 5是在3个数据集上分别进行十二分类的消融实验结果。网络将3个模块融合使用, 使得神经元形态分类获得更高的分类准确率, 在3个数据集上的分类准确率分别为96.7%, 86.94%, 85.84%, 相比较于基础网络, 分别提高了9.05%, 2.56%, 0.27%。

| FRM | weight | RRM | 分类准确率/% | ||

| Img_raw | Img_resample | Img_XYalign | |||

| × | × | × | 87.65 | 84.38 | 85.57 |

| √ | × | × | 94.15 | 85.47 | 85.81 |

| × | √ | × | 93.16 | 84.44 | 85.52 |

| × | √ | √ | 94.63 | 85.48 | 85.11 |

| √ | √ | × | 95.09 | 85.90 | 84.56 |

| √ | √ | √ | 96.70 | 86.94 | 85.84 |

通过消融实验, 验证了同时融合3个模块可以解决传统卷积提取边缘特征能力的不足, 并增强网络学习的能力, 能有效地增强神经元形态特征的表达能力和提升网络的整体性能, 从而提高网络对神经元形态类型分类的准确率。

3.5 不同分类方法性能对比为了探究该方法在神经元形态数据集上的表现能力, 将本文提出方法与现有的经典图像分类网络(ResNet[7]、ResNeXt[22]和文献[16])进行对比, 分别在3个神经元形态数据集上进行二分类和十二分类实验。此外, Zhang等[16]提出不同类型的深度卷积网络可以处理不同格式的神经元形态特征, 对于SWC格式数据提出了Tree-RNN模块, 对于神经元二维图像构建卷积神经网络(CNN), 并将2个模型集成获取最终的分类结果。而本文只针对神经元二维图像进行研究, 为了实验的合理性, 实验对比的数据是在神经元二维图像数据集上的分类准确率。

表 6的数据为本文提出的网络模型与其他分类方法在3个数据集上进行二分类的实验结果。其中FRSRN在Img_raw数据集上分类准确率达到了95.19%, 在Img_resample数据集上分类的准确率为87.67%, 在Img_XYalign数据集上取得了87.18%的准确率。对比基础网络ResNet18, FRSRN在3个数据集上的分类准确率分别提高了8.38%, 2.41%, 1.68%。与Zhang等[16]使用CNN方法相比, FRSRN在3个数据集上的分类准确率分别提高了7.32%, 3.63%, 1.52%。从表中的实验数据可以看出, 本文提出的方法在处理神经元二分类任务中获得较高的分类准确率。

表 7展示了本文提出的网络模型与其他分类方法在3个数据集上进行十二分类的实验结果。与其他分类方法相比较, FRSRN在神经元形态分类的准确率上有了明显提升, 其中在Img_raw数据集上分类准确率达到了96.7%, 在Img_resample数据集上分类的准确率为86.94%, 在Img_XYalign数据集上取得了85.84%的准确率。与基础网络ResNet18对比, FRSRN在3个数据集上的分类准确率分别提高了9.05%, 2.56%, 0.39%。与文献[16]使用的CNN方法相比, FRSRN在3个数据集上的分类准确率分别提高了10.7%, 3.7%, 0.16%。

综上, 使用了不同分类方法对神经元分类性能进行比较, 证明了本文提出的特征重构自愈残差网络在神经元形态数据集上对神经元类型进行分类的有效性。同时也说明了融合特征重构子模块和自注意力权重子模块能够有效提高网络性能, 增强神经元形态特征的表达, 从而有效地划分神经元类型。

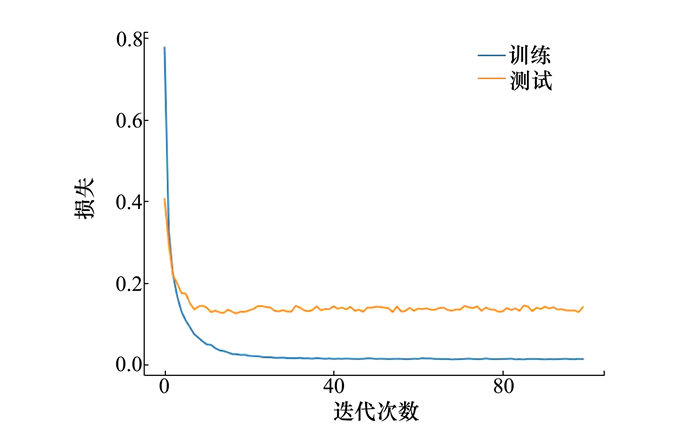

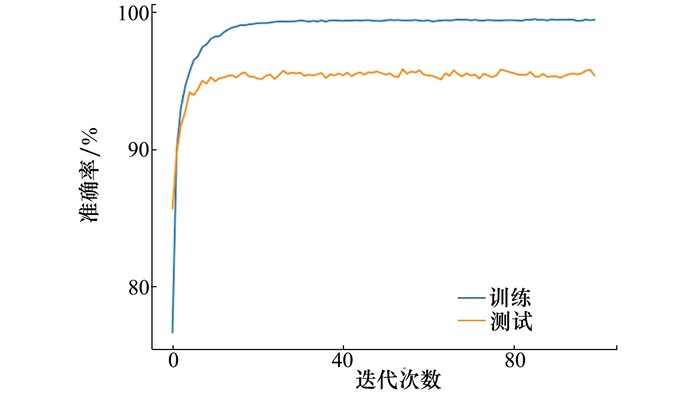

3.6 混淆矩阵与训练过程分析为了观察本文提出的特征重构自愈残差网络在神经元形态数据集上的训练过程及模型收敛情况, 将训练过程绘制成曲线图以便分析。

图 8为本文方法在训练和测试过程中的损失曲线图。从图中可以看出, 训练集和测试集的损失都能得到很好收敛, 在前20个迭代中, 两者的损失值均迅速下降, 其中测试集的损失值下降到0.15后趋于平稳。

|

| 图 8 FRSRN训练和测试的损失曲线 |

图 9为本文提出方法的分类准确率变化曲线图。从图中可以看出, 在整个过程中, 训练集和测试集在20个迭代之前准确率均迅速上升, 其中测试集的准确率上升到约95%趋于平稳。

|

| 图 9 FRSRN训练和测试的准确率曲线 |

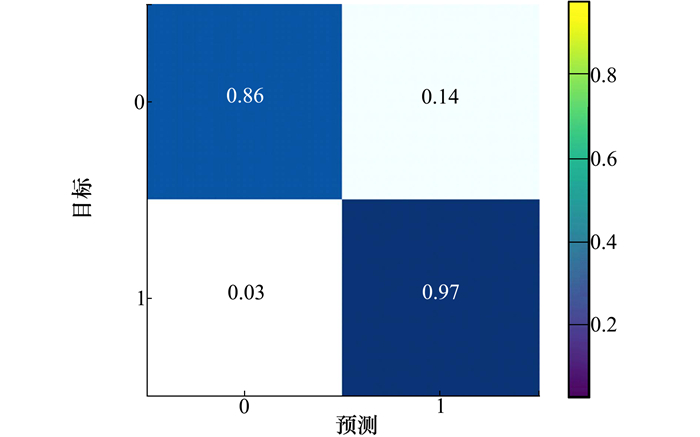

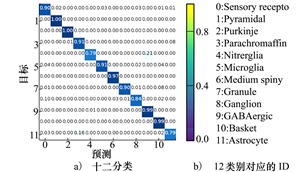

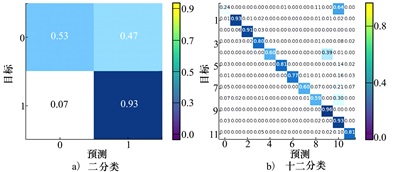

同时, 为了观察神经元类型的分类情况, 对神经元形态数据集进行混淆矩阵实验。图 10是神经元原始二维图像数据集的分类混淆矩阵, 图中“0”表示主神经元, “1”表示中间神经元,对角线上的值表示网络对神经元类型预测准确的概率。对于二分类, 主神经元的识别率为0.86, 中间神经元的识别率为0.93。十二分类的混淆矩阵如图 11所示, 其中感受体细胞和金字塔神经元的识别率均为1, 且大部分的神经元识别率都超过了0.9, 说明网络能很好地准确分类原始神经元图像。图 12给出了分类Img_resample数据集的混淆矩阵, 二分类中由于神经元类内形态结构高度相似, 主神经元很大概率会被识别成中间神经元。而经过处理的神经元数据, 在十二分类中神经元识别效果却没有原始的数据好, 如在识别感受体细胞时, 有0.64的概率被预测成了蓝状细胞, 证明这2类细胞的形态相似度比较高。

|

| 图 10 Img_raw的二分类混淆矩阵 |

|

| 图 11 Img_raw混淆矩阵 |

|

| 图 12 Img_resample混淆矩阵 |

根据上述实验结果可以看出, 应用特征重构自愈残差网络分类神经元的形态类别, 在Img_raw数据集上达到了很好的分类效果。而在网络处理Img_resample数据集时, 面对几何形态差异较小的神经元时分类效果不甚理想。

3.7 结果可视化与分析卷积神经网络对神经元图像形态分类的性能表现优异, 但其无法观察到网络模型提取到的高维特征是否具有可分性。因此需要将高维特征数据进行有效的可视化以更加直观和方便地分析高维特征数据。本文采用t-SNE(t-distributed stochastic neighbor embedding)[21]算法将数据可视化。t-SNE是一种非线性降维算法, 可以保留数据的局部和全局结构。在高维样本点空间中构建条件概率

|

(6) |

式中:σi表示方差。

本文将高维数据映射到二维空间, 使用条件概率来衡量高维和低维数据点之间的相似性

|

(7) |

同时使用KL散度衡量2个分布之间的差异

|

(8) |

图 13展示了对基于FRSRN提取到的高维特征进行t-SNE分析的示意图,其中“0”代表主神经元,“1”代表中间神经元。初始化数据向量维数为121,将其降维并做可视化处理如图 13所示。图中不同神经元的分布区域不同,只有少数中间神经元被错分为主神经元,结果表明FRSRN可以有效地检测到神经元的形态特征。

|

| 图 13 FRSRN进行二分类的t-SNE可视化 |

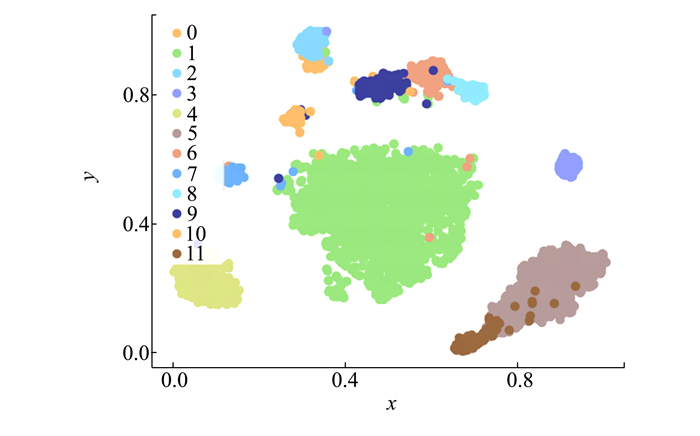

图 14给出了十二分类神经元的t-SNE分布,将不同类型的神经元划分为不同的样本组,意味着神经元类型的分类符合网络学习到的特征。

|

| 图 14 FRSRN进行十二分类的t-SNE可视化 |

针对神经元的形态结构复杂, 不同神经元之间的形态特征相似度高, 难以实现自动分类的问题, 提出了一种基于特征重构自愈残差网络的神经元形态分类方法, 可以有效地抑制传统卷积带来的缺陷, 防止深度卷积网络过度拟合神经元图像。本文提出的网络先以ResNet18为基础网络, 提取神经元的形态特征, 然后在网络后端构建特征重构模块, 使用亚像素卷积对特征图进行重组, 并使用大步幅的卷积核二次提取特征, 从而缓解特征到侵蚀。同时, 使用自注意力权重模块捕获样本权重进行损失加权, 并采用排序正则化模块作为辅助模块, 确保自注意力权重模块学习到有意义的样本, 从而提高分神经元分类准确率。所提出的方法有效地提高了网络对神经元形态特征相关区域的关注度, 与基础网络模型和其他经典的分类方法相比, 可以有效地提高神经元形态分类的准确率。当然, 神经元形态分类方法还有着较大的改进空间, 实验中发现仍存在一些问题对神经元形态分类效果具有较大影响, 如神经元各类型之间存在高度相似性, 尤其是同种类型的不同亚类之间具有高度相似的结构, 网络难以从这些样本中学习到细微的差异性特征。在未来的工作中, 将进一步考虑神经元的几何形态特性, 实现更多的面向神经元分类任务的网络, 提高判别性特征的质量, 进而更好地完成神经元形态分类任务。

| [1] |

蔺想红, 张玉平, 李志强, 等. 三维神经元几何形态生成算法研究进展[J]. 计算机工程, 2015, 41(2): 161-166.

LIN Xianghong, ZHANG Yuping, LI Zhiqiang, et al. Research progress on geometric morphology generation algorithms for 3D neurons[J]. Computer Engineering, 2015, 41(2): 161-166. (in Chinese) |

| [2] | Oshio K, Yamada S, Nakashima M. Neuron classification based on temporal firing patterns by the dynamical analysis with changing time resolution(DCT) method[J]. Biological Cybernetics, 2003, 88(6): 438-449. DOI:10.1007/s00422-003-0396-8 |

| [3] | GOUWENS N W, BERG J, FENG D, et al. Systematic generation of biophysically detailed models for diverse cortical neuron types[J]. Nature Communications, 2018, 9(1): 710. DOI:10.1038/s41467-017-02718-3 |

| [4] | ARENDT D, MUSSER J M, BAKER C V H, et al. The origin and evolution of cell types[J]. Nature Reviews Genetics, 2016, 17(12): 744-757. DOI:10.1038/nrg.2016.127 |

| [5] | KRIZHEVSKY A, SUTSKEVER I, HINTON G E. ImageNet classification with deep convolutional neural networks[J]. Communications of the ACM, 2017, 60(6): 84-90. DOI:10.1145/3065386 |

| [6] | SHI J, ZHU S, WANG D, et al. ARM: a lightweight module to amend facial expression representation[J]. Signal, Image and Video Processing, 2022, 17(4): 1315-1323. |

| [7] | HE K, ZHANG X, REN S, et al. Deep Residual Learning for Image Recognition[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, 2015: 770-778 |

| [8] | SHI W, CABALLERO J, HUSZÁR F, et al. Real-time single image and video super-resolution using an efficient sub-pixel convolutional neural network[C]//Proceedings of the IEEE Computer Society Conference on Computer Vision and Pattern Recognition, 2016: 1874-1883 |

| [9] | WANG T, LIAO D. Neuronal morphology classification based on SVM[C]//2011 International Conference on Computer Science and Service System, 2011 |

| [10] | ALAVI A, CAVANAGH B, TUXWORTH G, et al. Automated classification of dopaminergic neurons in the rodent brain[C]//2009 International Joint Conference on Neural Networks, 2009: 81-88 |

| [11] | VASQUES X, VANEL L, VILLETTE G, et al. Morphological neuron classification using machine learning[J]. Frontiers in Neuroanatomy, 2016, 10(102): 102. |

| [12] | FOGO G M, ANZELL A R, MAHERAS K J, et al. Machine learning-based classification of mitochondrial morphology in primary neurons and brain[J]. Scientific Reports, 2021, 11(1): 5133. DOI:10.1038/s41598-021-84528-8 |

| [13] | LIN X, ZHENG J. A Neuronal morphology classification approach based on locally cumulative connected deep neural networks[J]. Applied Sciences, 2019, 9(18): 3876. DOI:10.3390/app9183876 |

| [14] | LIN X, ZHENG J, WANG X, et al. A neuronal morphology classification approach based on deep residual neural networks[J]. Neural Information Processing, 2018, 11304: 336-348. |

| [15] |

蔺想红, 郑鉴洋, 王向文, 等. 基于深度学习网络的神经元自适应投影分类方法[J]. 电子学报, 2020, 48(7): 1321-1329.

LIN Xianghong, ZHENG Jianyang, WANG Xiangwen, et al. Neuronal adaptive projection classification method based on deep learning network[J]. Acta Electronica Sinica, 2020, 48(7): 1321-1329. (in Chinese) |

| [16] | ZHANG T, ZENG Y, ZHANG Y, et al. Neuron type classification in rat brain based on integrative convolutional and tree-based recurrent neural networks[J]. Scientific Reports, 2021, 11(1): 7291. DOI:10.1038/s41598-021-86780-4 |

| [17] | YAMASHIRO K, LIU J, MATSUMOTO N, et al. Deep learning-based classification of GAD67-positive neurons without the immunosignal[J]. Frontiers in Neuroanatomy, 2021, 15: 643067. |

| [18] | SHI Jiawei, ZHU Songhao, LIANG Zhiwei. Amending facial expression representation via de-albino[C]//2022 41st Chinese Control Conference, 2022 |

| [19] | HU W, HUANG Y, ZHANG F, et al. Noise-tolerant paradigm for training face recognition CNNs[C]//2019 IEEE/CVF Conference on Computer Vision and Pattern Recognition, 2019: 11879-11888 |

| [20] | VAN DER MAATEN L, HOMTON G. Visualizing data using t-SNE[J]. Journal of Machine Learning Research, 2008, 9: 2579-2605. |

| [21] | SIMONYAN K, ZISSERMAN A. Very deep convolutional networks for large-scale image recognition[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, 2015: 1409-1556 |

| [22] | XIE S, GIRSHICK R, DOLLÁR P, et al. Aggregated residual transformations for deep neural networks[C]//30th IEEE Conference on Computer Vision and Pattern Recognition, 2017: 5987-5995 |