阵列信号处理主要是利用信号的空域特性增强信号并有效提取信号空域信息。阵列信号处理作为现代信号处理的一个重要领域,被广泛应用于射电天文、图像识别、地震勘测、医学检测以及移动通信、雷达、声呐等各个领域中[1]。随着阵列信号处理的研究与发展,空间特征的提取与利用也成为热点与焦点。但通常的阵列信号处理都是在理想情况下,即以天线阵列不存在通道幅相误差、阵元位置误差和阵元互耦效应等阵列误差为前提,然而工程应用中,误差普遍存在,尤其是随着现代战争对各种飞行器的高速高机动性能要求不断提高,搭载在其上的天线阵列受影响程度逐渐增大,因此阵列校正成为工程化应用的关键。

目前,在阵列天线校正领域主要包括有源校正和自校正两类方法[2-3]。有源校正[4-7]通过在空间内特定位置处设置辅助信号源,辅助估计分析阵列误差,实现阵列参数离线校正。这种校正方法实现简单、计算量小,得到了比较广泛的应用,但是此类算法对辅助信号源的方位信息精度要求较高,因此当辅助信号的方位信息出现较大偏差时(特别是阵列的扰动和方位相关时)这类算法会出现较大的偏差。Liu等[4]提出参考阵列结构特点利用校准信号对不完全L形阵列校准的方法,以及基于传感器分布特性,对迭代极大似然(ML)校准算法作线性回归的改进算法。张珂等[5]提出一种简化的多级维纳滤波器(SMSWF)算法,利用校正源的方位和波形信息能够在参数估计过程中精简计算过程,简化特征分解的步骤,降低计算复杂度,加快幅相误差估计。Ng等[6]通过对协方差矩阵的特征值分解,利用信号子空间和噪声子空间的正交特性,实现幅相误差的计算。姜祖青等[7]基于最大似然准则,提出一种新的多径场景下乘性阵列误差有源校正算法,以牛顿(Newton)法的交替迭代实现乘性阵列误差参数、校正源多径传播方位以及多径衰减系数的数值优化。自校正[8-10]一般是通过某些优化算法对空间信源的方位与扰动的阵列参数进行联合估计,从而实现参数在线校正。这种校正方法不需要辅助信号源,估计精度较高,但由于阵元位置和相位等误差参数与方位参数的耦合及阵列结构的缺陷导致参数估计唯一性难以保证,同时参数联合估计涉及的高维、多模非线性问题带来巨型计算量,常常无法保证参数估计的全局收敛以致得不到最优结果。Zhao等[8]提出一种基于多个突击目标的宽带MIMO成像雷达阵列误差估计与补偿方法。林潇[9]将标量阵列下的经典迭代自校正算法扩展至极化域,提出了DOA-极化-误差的降维迭代自校正算法。Liu等[10]利用阵列天线误差矩阵的稀疏性特点,提出一种适用于一维均匀线阵的误差自校正算法。综上所述,现有的有源校正方法和自校正方法重点针对缓慢变化的阵列误差,在解决快速变化的阵列误差(阵列时变误差)校正问题上存在较大的局限性,前者受辅助信号源影响较大,后者由于高维、多模非线性带来的巨型计算量致使实时性差,并且难以应用于大阵列误差场合[11]。然而,随着现代作战平台的高速、高机动化,部署在这些作战平台的阵列因平台振动引发的时变幅相误差问题凸显。而针对如何校正此类时变幅相误差的具体方法目前国内外公开资料较少。

自编码器(autoencoder, AE)[12]及其变种作为一类特殊的神经网络,在无监督和半监督学习中一直扮演着重要的角色,起初是为了解决数据降维问题而提出的,它是以输入数据牵引网络的学习,提取出数据的通用特征表示,实现对输入数据的重构。自编码器的概念最早由Rumelhart等提出,Bourlard等对其进行了细致的阐述。随着深度学习得到空前的关注,AE也被不断地研究与改进[13-16]。Ng[13]提出了稀疏自编码器(spare autoencoder, SAE),将稀疏性限制引入隐含层,实现网络通过较少的神经节点提取有效特征。Vincent等[14]提出了去噪自编码器(denoising autoencoder, DAE),其思想是使用加入噪声的样本重构无噪声的样本,从而使提取的特征更具稳定性。Rifai等[15]提出了收缩自编码器(contractive autoencoder, CAE),利用收缩正则化项约束损失函数,实现局部空间收缩的效果。Kingma等[16]提出了变分自编码器(variational autoencoder, VAE),主要用于生成数据。之后还发展出了卷积自编码器(convolutional autoencoder, CoAE)、极限学习机-自编码器(extreme learning machine autoenco-der, ELM-AE)等变种。凭借着训练过程简单、多层堆栈容易、泛化性能优秀的特点,AE及各种改良算法被广泛应用于目标识别[17]、入侵检测[18]及故障诊断[19]等领域。通过对AE的特征压缩与提取能力、数据去噪能力以及无监督学习能力的分析,本文认为AE为解决时变误差校正问题提供了一个思路。

本文针对当前时变幅相误差无法有效校正的问题,结合自编码器思想,提出一种基于深度学习的阵列时变幅相误差校正算法。算法充分利用自编码器网络的数据特征提取、特征压缩与重构能力,设计了针对通道时变幅相误差校正的深度学习网络,给出了理想数据与时变扰动数据双驱动下的学习机制,基于期望输出与理想模型均方误差最小化原则,完成了对阵列流形隐匿特征提取与压缩,实现了阵列时变幅相误差的有效校正,并显著提升了接收信号的信噪比。

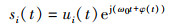

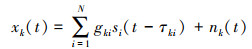

1 阵列信号模型假设N个远场窄带信号入射到空间中由M个阵元组成的阵列天线上(这里认为阵元数和通道数一致)。在窄带信源假设下,信号可以表示为如下复包络形式:

|

(1) |

|

(2) |

式中:ui(t)是阵元接收信号幅度;φ(t)是阵元接收信号的相位;ω0是阵元接收信号的频率。在窄带远场信号源的假设下[20]有

|

(3) |

|

(4) |

第k个阵元接收到的信号为

|

(5) |

式中: gki是第k个阵元对第i个信号的增益,k=1, 2, …, M; nk(t)是第k个阵元在t时刻的噪声; τki是第i个信号到达第k个阵元时相对于参考阵元的时延。把M个阵元在某一时刻接收到的信号排列成一个列矢量得到

|

(6) |

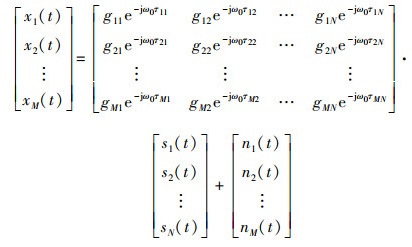

在理想情况下, 阵列中各阵元各向同性且不存在通道不一致、互耦等因素影响, (6)式中增益可以省略(即归一化为1), 故(6)式可以化简表示为

|

(7) |

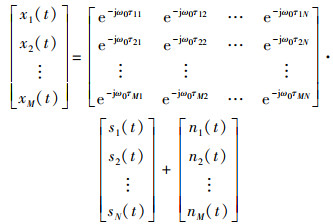

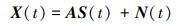

将(7)式改写为矢量形式

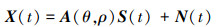

|

(8) |

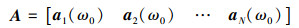

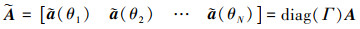

式中:X(t)是M×1维阵列快拍矢量;N(t)是M×1维阵列噪声数据矢量;S(t)是N×1维空间信号矢量;A是M×N维空间阵列流形矩阵(导向矢量矩阵), 其中

|

(9) |

导向矢量

|

(10) |

式中,

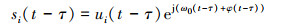

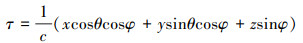

假设空间任意2个阵元位置如图 1所示。

|

| 图 1 阵元空间几何结构图 |

其中一个阵元为参考阵元,位于原点, 另一个阵元的空间坐标为(x, y, z), 由几何关系可以计算出2个阵元间的时延

|

(11) |

日常工程应用中阵列误差大致可分为4类[21]: 阵元方向图误差、阵元通道幅相误差、阵元互耦误差、阵元位置误差。下面主要讨论阵元通道幅相误差。实际应用中阵元通道的不一致性直接受通道中有源器件的状态影响。有源器件状态的不一致(采样器件的非线性和失真、滤波器中的带通波纹、放大器的增益误差以及相移等)和外界环境变化(温度、湿度、气压)等因素都会引起阵元通道幅相误差。具体来说天线振动导致内部有源器件出现位移和形变, 进而引起阵元通道的增益和相位变化,导致幅相误差出现。

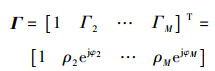

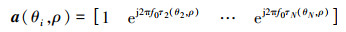

因此, 阵元通道增益不一致造成的阵元通道的幅相误差可以在导向矢量前乘以(方位无关)幅相误差矢量

|

(12) |

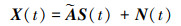

对于任意几何结构具有M个阵元的典型阵列, 在远场空间有N个(M>N)窄带信号源以平面波入射(波长为λ0), 方位矢量为θ = [θ1 θ2 … θN]。将第一个阵元所在位置作为参考坐标原点位置, 空间阵列接收到的快拍数据矢量表示为

|

(13) |

式中: X(t)是M×1维阵列快拍矢量; N(t)是M×1维阵列噪声数据矢量; S(t)是N×1维空间入射信号矢量; A(θ, ρ)是M×N维阵列流形矩阵A(θ, ρ)=[a(θ1, ρ) a(θ2, ρ) … a(θN, ρ)], 其中a(θj, ρ)为第i个信源对应的阵列导向矢量, ρ是与导向矢量有关的阵列参数(幅相误差、阵元互耦误差、阵元位置误差等), 假设阵元无幅相误差、各阵元是完全相同的全向天线, 同时第一个阵元的复增益归一化为1时, 阵列导向矢量表示为

|

(14) |

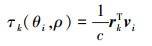

|

(15) |

|

(16) |

|

(17) |

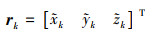

式中: τk(θi, ρ)是第i个信号源到达第k个阵元时相对于第一个阵元的时延; rk是第k个阵元的坐标矢量; vi是第i个信号源的方位矢量。

根据以上内容可以得出含有与方位无关的幅相误差的阵列导向矢量

|

(18) |

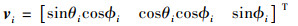

并且可以得到空间阵列的M×N维流形矩阵(导向矢量矩阵)

|

(19) |

空间阵列接收到的含幅相误差的信号数据可以表示为以下矢量形式

|

(20) |

基于自编码器的时变幅相误差校正算法的网络结构基于传统自编码器(AE)的基础, 引入去噪自编码器(DAE)的设计思路, 对输入的加扰阵列数据, 利用自编码器(AE)的特征压缩和提取能力, 实现加扰阵列数据的退化处理, 按照输入的无扰动数据样本分布将扰动数据的部分特征值置零, 提取出其中无扰动数据的特征, 最终利用这些特征重构出无扰动阵列数据, 从而实现阵列误差的校正。

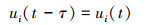

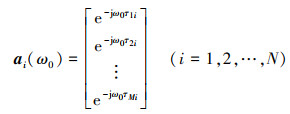

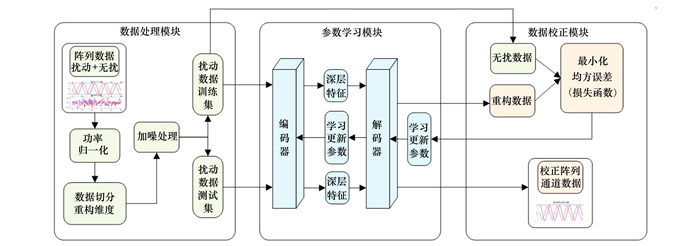

本文算法主要有3个模块: 数据处理模块、参数学习模块和数据校正模块, 如图 2所示。

|

| 图 2 基于自编码器的时变幅相误差校正模型 |

数据处理模块输入从阵列采集到的扰动数据和无扰数据, 对其进行尺度变换、功率归一化、切片和加噪等操作, 划分训练集、测试集和验证集。参数学习模块主要由编码器和解码器组成。编码器将输入的扰动数据进行特征提取和特征压缩, 从而得到阵列数据的深层特征表示; 解码器利用提取出的高度抽象的特征进行数据重构, 在网络训练过程中, 将重构数据与无扰数据进行比对, 最小化两者的均方误差; 在测试阶段, 利用训练好的网络对输入的扰动数据进行深层特征提取, 并重构出无扰数据, 实现数据误差校正。

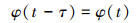

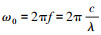

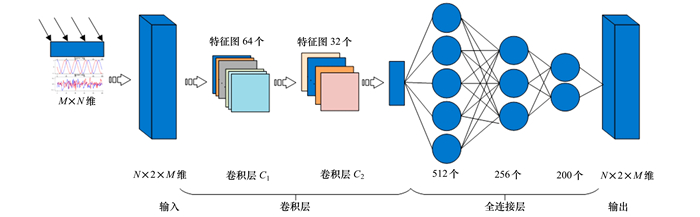

3.2 网络结构设计时变幅相误差校正网络结构如图 3所示。本文算法为实现对阵列时变幅相误差的校正, 同时确保数据校正精度, 将整体网络设计为4层: 输入层、卷积层(2层)、全连接层(3层)和输出层。位于数据处理模块的输入层将采集到的阵列数据(扰动数据和无扰数据)进行尺度变换,由M×N维转换为M×2×N×1维。考虑到阵列天线的结构特征, 采集到的阵列数据具有空间特性, 将网络参数学习模块的编码过程设计为2层卷积神经网络, 以便更好地保留空间信息, 通过二维卷积conv2D, 以same模式对M×2×N×1维扰动数据进行卷积操作, 即在卷积操作中对每一个样本的边缘进行补零操作, 在充分提取特征的前提下, 确保卷积到的样本尺度不变, 卷积核尺寸kernel_size都为(1, 4), 特征通道数filters分别为64, 32, 提取出M×64维和M×32维特征, 之后采用ReLU函数激活。ReLU激活函数采用具有分段线性的整流线性单元[22](rectified linear unit, ReLU)促进了梯度的反向传播并降低了激活函数的计算量, 而且ReLU函数的部分激活特性相当于对网络施加了稀疏正则化, 一定程度上能够提高网络的鲁棒性和泛化能力。网络参数学习模块的解码过程采用3层全连接神经网络重构阵列数据, 并通过反向传播算法, 最小化重构数据与无扰动阵列数据的差异, 通过输入的扰动数据和无扰动数据的双驱动, 使网络学习到无扰动阵列数据的深层规律, 以达到对扰动后阵列的实时校正, 为有效利用编码部分提取到的潜在特征并方便数据重构, 将3层全连接网络的节点数分别设计为512, 256, 200, 前2层的激活函数为ReLu, 最后1层的激活函数为双曲正切(hyperbolic tangent, tanh)函数。经过3层全连接层输出的重构数据尺度为N×2×M×1维, 再经过数据尺度变换得到N×M维重构数据。

|

| 图 3 基于自编码器的时变幅相误差校正网络结构 |

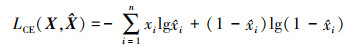

在传统自编码器(AE)网络中, 损失函数通常可取均方误差(mean square error, MSE)或者交叉熵(cross entropy, CE)。对于输入样本X ={xi∈ Rd}i=1n与重构

|

(21) |

|

(22) |

通常情况下交叉熵(cross entropy, CE)损失函数用于分类任务, 一般同softmax函数一起使用。文中设计的算法是为了重构无扰阵列数据,属于回归任务, 因此采用均方误差(mean square error, MSE)损失函数。通过最小化重构数据与无扰数据间的均方误差达到对阵列误差的高精度校正。

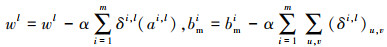

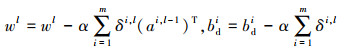

采用自适应梯度下降(adaptive momentum, Adam)算法进行网络参数优化, 优化目标即为最小化损失函数

算法流程:

1) 初始化各隐藏层与输出层的W, bm, bd的值为一个随机值;

2) for epoch to 1 to Imax:

for i=1 to m:

将网络输入ai设置成xi对应的张量:

ai, l=σ(zi, l)=σ(wl*ai, l-1+bm)

for l=2 to L-4, 卷积层进行前向传播算法计算:

ai, l=σ(zi, l)=σ(wl*ai, l-1+bd)

对于输出层第L层:

ai, l=tanh(zi, l)=tanh(wL*ai, L-1+bdL)

通过损失函数C计算输出层的误差δi, l:

|

for l=L-1 to L-3, 全连接层进行反向传播算法计算:

δi, l=(wl+1)Tδi, l+1⊙σ′(zi, l)

for l=L-4 to 2, 卷积层进行反向传播算法计算:

δi, l=δi, l*rot180(wl+1)⊙δ′(zi, l)

for l=L-3 to L-1, 全连接层进行前向传播算法计算:

for l=2 to L-4, 更新卷积层中第l层的wl, bdl:

|

for l=L-3 to L, 更新全连接层中第l层的wl, bdl:

|

如果所有W, bm, bd的变化值都小于停止迭代阈值ε, 则跳出迭代循环到步骤3);

3) 输出各隐藏层与输入层的线性关系系数矩阵W和偏置bm, bd。

上述流程中, m表示样本个数, L表示模型层数, Imax表示最大迭代次数, a表示网络中的输入, z表示网络中的输出, σ表示激活函数, W表示隐藏层和输入层的权值矩阵, bm表示编码层节点偏置, bd表示解码层偏置, ε表示停止迭代阈值, ⊙为Hadamard积, 在卷积层中使用卷积核尺寸为u×v。

4 实验仿真与结论为验证本文提出算法的有效性,利用计算机进行了多种背景下的蒙特卡罗仿真实验。实验部分采用随机时变幅相误差主要出于以下几点考虑:①天线振动的复杂性导致具体建模存在较大的局限性; ②通过随机幅相误差可以表示大多数类型的幅相误差; ③在实际应用中阵列搭载平台的运动类型未知,运动导致的阵列振动类型未知,因此采用随机时变幅相误差具有普遍适用性。文中实验平台是Inter(R)Core(TM)CPU(2.6 GHz)和一个Nvidia Quadro T2000 GPU的计算机。

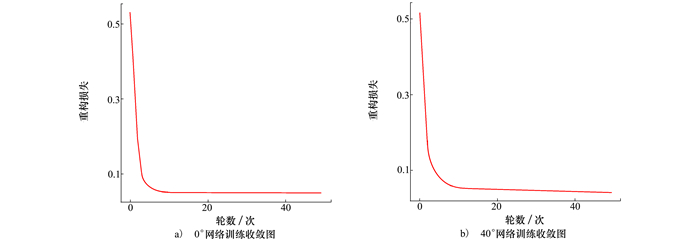

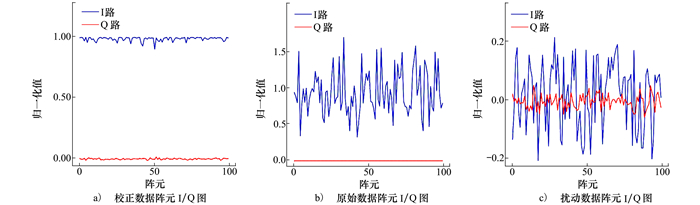

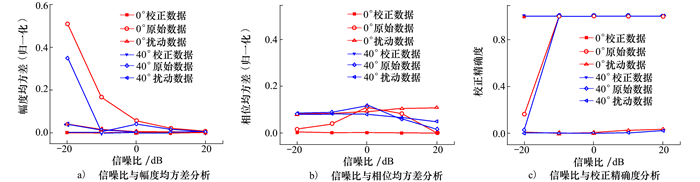

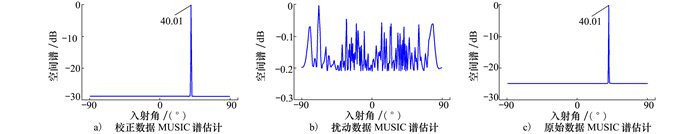

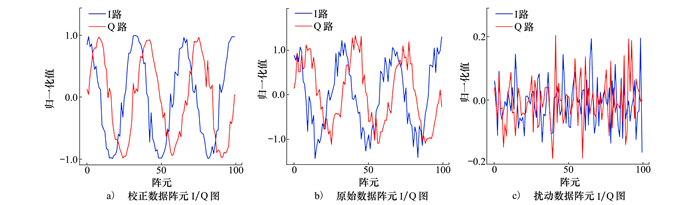

仿真1:(单一角度)假设阵列天线为均匀线阵,阵元数目为100,快拍数为100,在0°, 40°来波方向,阵元的幅度误差为-80%~80%的随机误差(阵元幅度归一化),阵元的相位误差为-5°~5°的随机误差(初相为0°),算法网络训练时信噪比为10 dB,采集数据信噪比分别为20, 10, 0, -10, -20 dB,分别进行2 000次的蒙特卡罗实验,经过对上述实验据的整理得到结果如图 4~6所示。

|

| 图 4 0°和40°网络训练收敛图 |

|

| 图 5 0°网络重构数据I/Q图 |

|

| 图 6 40°网络重构数据I/Q图 |

从图 4可以得出,网络对单一方向数据进行训练时可以在5个轮次内完全收敛,数据处理时间短,可以实现实时校正。图 5和图 6可以看出经算法校正过数据的I/Q图相较扰动数据的I/Q图变化极大,校正数据的I/Q图基本与加噪原始数据的I/Q图一致,说明算法可以实现对幅相的校正。

表 1~2中,ρi,

| 阵元 | ρ0° |  |

ρ40° |  |

φ0° |  |

φ40° |  |

| 1 | 1.001 0 | 0.997 3 | 1.025 0 | 0.997 9 | 0.002 2 | 0.001 0 | 0.000 6 | 0.020 4 |

| 10 | 0.999 5 | 0.989 8 | 1.025 0 | 0.991 3 | 0.002 5 | -0.002 3 | 0.675 1 | -0.013 5 |

| 15 | 1.001 0 | 0.998 9 | 1.024 9 | 0.999 1 | 0.002 7 | 0.000 3 | -0.016 2 | -0.006 9 |

| 54 | 0.998 9 | 0.969 0 | 1.024 7 | 0.971 9 | 0.002 5 | -0.001 1 | -0.213 6 | -8.07×10-5 |

| 92 | 0.998 6 | 0.991 4 | 1.024 4 | 0.992 9 | 0.002 8 | 0.000 9 | -1.551 4 | 0.009 2 |

| 阵元 | Δρ0° |  |

Δρ40° |  |

Δφ0° |  |

Δφ40° |  |

| 1 | 0.021 1 | 4.50×10-5 | 0.014 8 | 4.19×10-5 | 0.080 2 | 0.000 3 | 0.016 8 | 0.000 4 |

| 10 | 0.022 3 | 0.000 1 | 0.015 8 | 0.000 1 | 0.085 5 | 0.000 4 | 0.016 5 | 0.000 4 |

| 15 | 0.022 2 | 2.25×10-5 | 0.014 8 | 2.05×10-5 | 0.088 2 | 0.000 4 | 0.024 0 | 0.000 4 |

| 54 | 0.022 5 | 0.000 3 | 0.015 3 | 0.000 3 | 0.085 5 | 0.000 4 | 0.017 3 | 0.000 4 |

| 92 | 0.021 0 | 0.000 1 | 0.015 7 | 0.000 1 | 0.089 4 | 0.000 4 | 0.018 0 | 0.000 4 |

根据表 1可以得出,在10 dB信噪比下,不同阵元通道的校正数据幅度和相位均值与原始数据的幅度和相位均值偏差分别在2.5%和5%以内,保持基本一致。从表 2中看出,各阵元通道的校正数据幅度和相位均方差变化较小,分别保持在0.1%和0.5%以内,波动较小,上述2个表说明了算法可以较好地完成数据校正并且具有很好的鲁棒性。

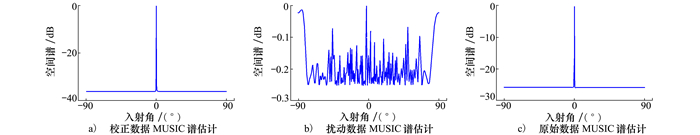

图 7中随着信噪比的不断提升算法的校正效果逐渐变好,阵列的幅度和相位误差分别保持在0.1%和0.5%之内。通过采用经典MUSIC算法对0°和40°来波方向的3类数据进行2 000次角度估计(角度误差在0.2°以内即为有效估计)得到图 7c)所示的结果,在-20 dB信噪比下原始数据无法进行角度估计,校正数据仍然能达到高的估计精确度,在信噪比-10 dB以上时本文算法可以达到和原始数据同等估计效果,而扰动数据则完全无法进行角度估计。

|

| 图 7 信噪比与校正误差分析 |

图 8~9直观展示了经过校正的数据和原始数据MUSIC谱,可以清晰地得出估计角度,而扰动数据则完全无法进行估计,进一步证明了文中算法的有效性。

|

| 图 8 0°阵列数据MUSIC谱图 |

|

| 图 9 40°阵列数据MUSIC谱图 |

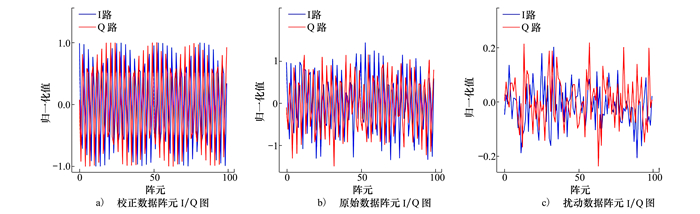

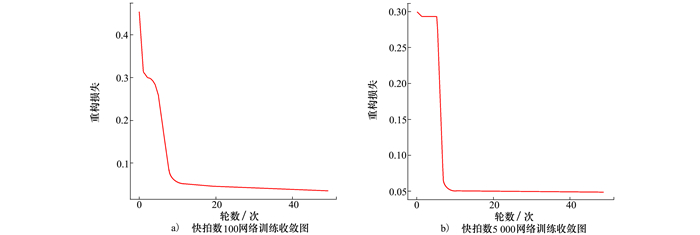

仿真2:(多角度)假设阵列天线为均匀线阵,阵元数为100,在-5°~5°的来波范围,阵元的幅度误差为-80%~80%的随机误差(阵元幅度归一化),阵元的相位误差为-5°~5°的随机误差(初相为0°),算法网络训练时信噪比为10 dB下进行网络训练后,采集-3°和2°方向来波,信噪比为10 dB的数据,在100, 500, 1 000, 2 000, 5 000次快拍下,进行2 000次蒙特卡罗实验,经过对上述实验数据的整理得到如图 10所示的结果。

|

| 图 10 -5°~5°快拍网络训练收敛图(快拍数100, 5 000) |

图 10可看出,随着快拍次数的增加和数据量的增大,网络训练时间逐渐增加,但仍保持在10个轮次之内,证明了算法处理数据的效率较高,可以达到实时校正的要求。

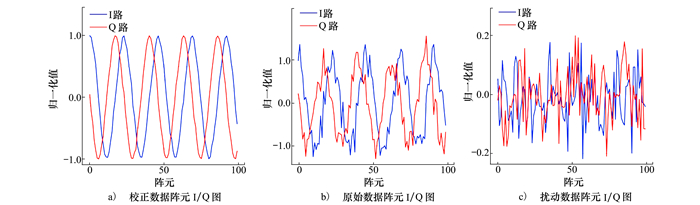

图 11和12分别展示了校正数据、原始数据和扰动数据的I/Q图,通过对比可以得出,经网络校正后的数据与原始数据相近,并且随着快拍次数的增加,网络对数据的校正效果逐渐变好。

|

| 图 11 -5°~5°网络重构数据I/Q图(快拍数100) |

|

| 图 12 -5°~5°网络重构数据I/Q图(快拍数5 000) |

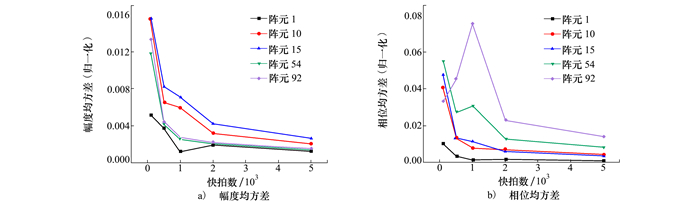

从图 13可以看出,随着快拍数的增加,阵列中各阵元通道的幅度校正值的均方差逐渐减小,在快拍数1 000时各阵元通道幅度校正值的均方差已经降到0.8%以下,同时,随着快拍数的增加,阵列中各阵元通道的相位校正值均方差逐渐减小,在快拍数1 000时各阵元通道相位校正均方差均已降到3%以下,由此证明了算法可以较好地完成对扰动数据幅度和相位的校正。理论上随着快拍数的不断增加,本文算法的幅相校正值均方差可以逐渐逼近0。同时实验中的快拍数即为网络的训练样本数,图中曲线表明网络的训练样本量为500时基本可以实现通道时变幅相误差校正, 样本量为2 000时达到较好的校正效果,样本量为5 000时校正效果接近最佳。

|

| 图 13 通道幅相误差值与快拍数分析 |

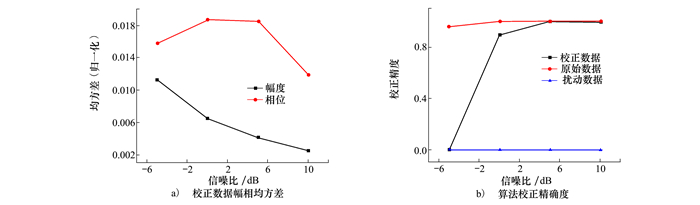

从图 14a)可以得出随信噪比的提升,在快拍数1 000下算法对整个阵列的幅度和相位校正值的均方差逐渐减小,在信噪比为10 dB时分别为0.3%和1.2%,说明了对幅相数据的校正具有很好的鲁棒性。通过经典MUSIC算法对-3°和2°来波方向的3类数据进行2 000次角度估计(角度误差在0.2°以内即可有效估计来波角度)得到如图 14b)所示的3类数据的估计结果,在信噪比达到0 dB以上时,本文算法校正的数据逐步逼近原始数据并达到同等的估计效果,而扰动数据则完全无法进行角度估计,证明了本文算法的有效性。

|

| 图 14 快拍数1 000下信噪比与校正误差分析 |

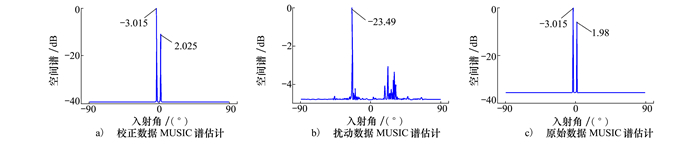

图 15展示了3类数据的MUSIC谱估计结果,校正数据和原始数据可以清晰准确地实现对多个来波角度估计,而扰动数据则完全失效,进一步证明文中算法的有效性。

|

| 图 15 -3°和2°快拍数1 000下MUSIC谱 |

本文针对传统阵列天线校正算法无法快速有效地进行阵列时变误差校正的问题,提出一种基于深度学习的阵列时变幅相误差校正算法。该算法将参数估计问题转换为机器学习中的特征提取和重构问题,利用自编码器的高隐匿特征提取能力以及深度神经网络的强数据重构表达能力,基于期望输出和理想模型均方误差最小化原则,旨在解决阵列时变幅相误差无法有效校正的问题。仿真结果表明该算法能够实现阵列时变幅相误差的有效校正,同时算法的鲁棒性较强,适用范围较广,对高速、高机动平台的阵列天线误差校正有一定的指导意义。在复合多种时变误差(阵元位置、阵元通道幅相、阵元方向图和阵元互耦误差)的阵列天线校正以及多种阵列结构下的时变误差校正是下阶段的研究方向。

| [1] |

平伏龙. 矢量共形阵列DOA与极化参数联合估计算法研究[D]. 成都: 电子科技大学, 2016 PING Fulong. Joint DOA and polarization estimation algorithm researching for polarization sensetive conformal array antenna[D]. Chengdu: University of Electronic Science and Technology of China, 2016 (in Chinese) |

| [2] |

姜雅东. 机载相干信源DOA估计与误差校正[D]. 成都: 电子科技大学, 2021 JIANG Yadong. DOA estimation of coherent source and array calibration for airborne[D]. Chengdu: University of Electronic Science and Technology of China, 2021 (in Chinese) |

| [3] |

吴迪. 阵列误差校正和波达方向估计研究[D]. 哈尔滨: 哈尔滨工程大学, 2015 WU Di. Research on array errors calibration and direction of arrival estimation[D]. Harbin: Harbin Engineering University, 2015 (in Chinese) |

| [4] | LIU Shiyan, ZHANG Zhi, GUO Yu. 2-D DOA estimation with imperfect L-shaped array using active calibration[J]. IEEE Communications Letters, 2021, 25(4): 1178-1182. DOI:10.1109/LCOMM.2020.3047222 |

| [5] |

张珂, 程菊明, 付进. 阵列通道不一致性误差快速有源校正算法[J]. 电子与信息学报, 2015, 37(9): 2110-2116.

ZHANG Ke, CHENG Juming, FU Jin. Fast active error calibration algorithm for array chanel uncertainty[J]. Journal of Electronics & Information Technology, 2015, 37(9): 2110-2116. (in Chinese) |

| [6] | NG B P, LIE J P, ER M H, et al. A practical simple geometry and gain/phase calibration technique for antenna array processing[J]. IEEE Trans on Antennas and Propagation, 2009, 57(7): 1963-1972. DOI:10.1109/TAP.2009.2021931 |

| [7] |

姜祖青, 杨宾. 一种新的多径场景下乘性阵列误差有源校正算法[J]. 信息工程大学学报, 2022, 23(2): 129-134.

JIANG Zuqing, YANG Bin. Novel multiplicative array errors active calibration algorithm in presence of multipath[J]. Journal of Information Engineering University, 2022, 23(2): 129-134. (in Chinese) |

| [8] | ZHAO Zheng, TIAN Weiming, DENG Yunkai, et al. Calibration method of array errors for wideband MIMO imaging radar based on multiple prominent targets[J]. Remote Sensin, 2021, 13(15): 2997. DOI:10.3390/rs13152997 |

| [9] |

林潇. 极化敏感阵列幅相误差自校正技术研究[D]. 哈尔滨: 哈尔滨工业大学, 2020 LIN Xiao. Research on self-correction technology for gain-phase error in polarization-sensitive array[J]. Harbin: Harbin Institute of Technology, 2020 (in Chinese) |

| [10] | LIU H, ZHAO L, LI Y, et al. A sparse-based approach for DOA estimation and array calibration in uniform linear array[J]. IEEE Sensors Journal, 2016, 16(15): 1-5. DOI:10.1109/JSEN.2016.2581558 |

| [11] | TUNCER E, FRIEDLANDER B. Classical and modern direction-of-arrival estimation[J]. Applied Acoustics, 2009, 71(5): 493. |

| [12] | RUMELHART D E, HINTON G E, WILLIAMS R J. Learning representations by back-propagating errors[J]. Nature, 1986, 323(6088): 533-536. DOI:10.1038/323533a0 |

| [13] | NG A. Sparse autoencoder[J]. CS294A Lecture Notes, 2011, 72(1): 1-19. |

| [14] | VINCENT P, LAROCHELLE H, LAJOIE I, et al. Stacked denoising autoencoders: learning useful representations in a deep network with a local denoising criterion[J]. Journal of Machine Learning Research, 2010, 11(12): 3371-3408. |

| [15] | RIFAI S, VINCENT P, MULLER X, et al. Contractive auto-encoders: explicit invariance during feature extraction[C]//Proceedings of the 28th International Conference on Machine Learning, 2011: 833-840 |

| [16] | KINGMA D P, WELLING M. Auto-encoding variational Bayes[J/OL](2022-12-10)[2023-01-01]. https://arxiv.org/abs/1312.6114.2022.3 |

| [17] | MIAN P, JIE J, ZHU L, et al. Radar HRRP recognition based on discriminant deep autoencoders with small training data size[J]. Electronics Letters, 2016, 52(20): 1725-1727. DOI:10.1049/el.2016.3060 |

| [18] |

王晨, 张迪明, 韩斌. 基于变分自编码和三支决策的工控入侵检测算法[J]. 信息技术与网络安全, 2022, 41(6): 10-17.

WANG Chen, ZHANG Diming, HAN Bin. An industrial intrusion detection algorithm based on variational autoencoder and three-way decisions[J]. NETwork and Information Security, 2022, 41(6): 10-17. (in Chinese) |

| [19] | ZHANG Y Y, GAO L, LI X Y, et al. A novel data-driven fault diagnosis method based on deep learning[C]//International Conference on Data Mining and Big Data, 2017: 442-452 |

| [20] |

王永良, 陈辉, 彭应宁, 等. 空间谱估计理论与算法[M]. 北京: 清华大学出版社, 2004: 19-20.

WANG Yongliang, CHEN Hui, PENG Yingning, et al. Spatial spectrum estimation theory and algorithms[M]. Beijing: Tsinghua University Press, 2004: 19-20. (in Chinese) |

| [21] |

崔伟. 基于改进粒子群算法的阵列天线误差校正的研究[D]. 镇江: 江苏科技大学, 2020 CUI Wei. Research on error correction of array antenna based on improved particle swarm algorithm[D]. Zhengjiang: Jiangsu University of Science and Technology, 2020 (in Chinese) |

| [22] | GLOROT X, BORDES A, BENGIO Y. Deep spare rectifier neural networks[C]//Proceedings of the 14th International Conference on Artificial Intelligence and Statistics, 2011: 315-323 |