2. 西北工业大学 软件学院, 陕西 西安 710072

作战意图识别旨在对来自各种信息源的信息进行分析, 从而解释和判断敌方想要达到的目的[1], 正确且高效的对敌意图识别能够有效抵御或杀伤敌方目标。随着科技的进步, 军事装备力量逐渐向着无人化、智能化的方向发展。作为实现作战过程智能化的重要一环, 作战意图识别逐渐成为各国研究的热点[2]。

传统作战意图识别通常采用领域专家知识指导的模板匹配方法[3-6]或者基于贝叶斯网络的推理方法[7-8]。模版匹配的方法是指敌方作战意图识别过程建立在领域专家制定的模板之上, 通过匹配算法匹配模板得到敌方作战意图。基于贝叶斯网络的方法是指依据战场行为序列构建贝叶斯网络, 并由领域专家确定网络参数实现敌方作战意图的推理。以往的军事信息化建设落后, 战场数据相对匮乏, 传统方法可以较好地适应这种情景准确的作战意图识别, 但是还存在以下问题未被有效解决。首先, 现代战场环境复杂多变, 作战样式与作战平台更新迅速, 从作战单元采集的作战目标状态数据呈现多维、海量的特性。而传统方法由于需要前期大量的领域知识建模, 难以有效地处理特性以及数据之间复杂的依赖关系。其次, 前期的领域知识模型构建也使得传统方法的模型主观性较强[9]。面对这样的挑战, 研究者们开始探究如何通过神经网络的方法进行作战目标意图识别。神经网络的方法可以不依赖专家选择特征, 通过抽取与意图相关的战场态势信息, 更好地适应现代战场数据。文献[10-12]采用模糊神经网络来进行意图识别, 该方法将模糊推理与神经网络结合, 在一定程度上提升了作战意图识别任务的精度, 但该方法网络层数浅, 难以较好对复杂数据拟合。为了解决该问题,文献[13]采用深度神经网络(deep neural networks, DNN)对空中目标作战意图进行识别, 可以达到一定的识别率, 但没有考虑到战场情报数据的时序性特点。面对这种时序性特点, 也有研究人员使用循环神经网络(recurrent neural networks, RNN)识别意图[14-15]。文献[16]基于长短时记忆网络(long short-term memory, LSTM)对作战意图进行分类, 采用学习因子自适应调整策略提高模型的训练效率, 文献[17-18]基于LSTM模型对空中目标进行意图识别。综上, 当前神经网络模型对意图识别可以达到比较好的识别率, 但在网络模型的设计方面没有考虑到作战意图识别面对的场景以及作战实体状态之间的关联关系。

对于实战场景下的作战目标意图识别问题, 战场情报数据是连续的, 每个时间点传感器收集的数据为作战目标在这个时刻的状态。随着时间的推移, 作战实体实施一系列行为以达到行动意图。因此, 作战意图的识别具有层次性, 由观测方观测敌方执行的一系列行为并不断向上推理得到实施方的意图。从时间角度来说, 该过程是作战目标状态的递进, 从正向推进完成了作战相应的作战意图, 后续状态又反向依赖前序状态。所以, 数据与数据之间存在着双向依赖的复杂关联。针对这样的过程, 当前的作战意图识别方法虽然在一定程度可以对作战目标意图进行识别, 但无法满足现代战场作战场景的层次性与作战时序数据双向依赖的复杂关联性特征。所以, 迫切需要一种感知场景特性的方法来完成作战意图识别任务, 以提高识别效果。

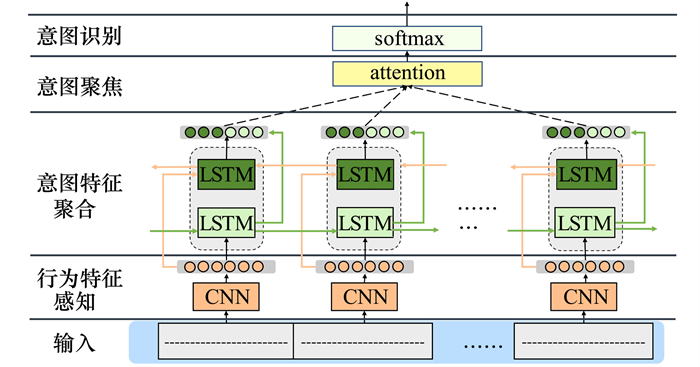

综上所述, 针对当前模型所面对的挑战, 本文提出一种层次聚合框架, 底层基于卷积神经网络(convolutional neural networks, CNN) 通过卷积操作感知行为特征。中间层基于双向长短时记忆网络(bi-directional long short-term memory, Bi-LSTM[19]), 将LSTM的神经元从2个不同的时间方向叠加, 借助LSTM记忆长时依赖信息的能力, 达到表达2个方向的长时依赖信息的目的。顶层通过注意力机制将特征聚焦于与识别意图更加相关的高级特征, 最终组合感知到的全局信息以识别目标作战意图。模型解决了当前意图识别的一些局限, 即缺乏对意图层次性、时间特性与双向依赖的表述。相比深度神经网络方法模型识别准确率提高了18.34%, 相比循环神经网络方法提高了17.72%, 相比长短时记忆网络方法提高了7.7%。

1 问题描述本问题针对的输入是传感器接收的连续时序数据, 该数据是一个时间周期内作战实体的特征参数, 用以描述一个时间段内实体的作战意图。神经网络对目标作战意图识别是从该时序数据中提取表达意图的特征向量, 并通过分类器对该向量学习得到最终作战意图的过程。该问题本质上是做神经网络的分类任务。

假设 给定一组作战过程序列数据X =[x1, x2, …, xt]i∈ RN×W, 其中, R代表实数空间, N, W分别是序列长度、特征维度, 每一条数据代表在特定时间点的作战实体参数信息, [·]i代表第i个目标的特征向量, xt代表第t个作战属性。通过对作战过程序列数据进行特征学习表征得到包含关键信息的嵌入。面对的问题可以形式化为如下数学表达

|

(1) |

|

(2) |

式中, [x1, x2, …, xt]i为序列中第i个目标的特征向量; [r1, r2, …, ri]i为对应的特征嵌入; f1为本文设计的层次聚合模型, 本质上是一个映射函数; f2是一个分类器; yi是目标i的意图。

2 作战意图识别模型本节详细介绍了所提出的层次聚合模型。模型针对作战目标意图识别面对的场景以及任务特征, 通过层次聚合从作战目标状态数据中逐级学习局部特征, 并通过注意力机制进行特征融合得到全局特征表示用以意图识别。

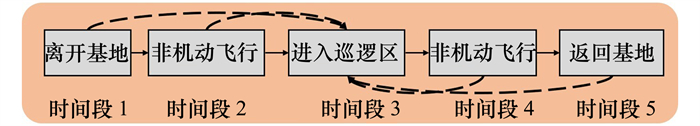

在现代空战中, 战场呈现复杂、多变等特征, 所以需要通过有限信息感知来判断态势以评估作战意图。如图 1所示, 作战意图识别是一个具有层次性的向上推理过程, 父意图可以分解为多个子意图, 而每个子意图又可以分解为一系列的行为。以巡逻意图为例, 说明空中作战目标进行巡逻时的意图分解过程。首先, 实体起飞离开基地; 然后, 执行非机动飞行子意图向指定巡逻区域飞行; 其次, 进入巡逻区, 然后继续非机动飞行; 最后, 执行完巡逻任务, 执行返回基地子意图。因此, 意图识别是从作战实体的各种状态特征表现出发, 先由状态特征分析出敌方行为序列, 再由行为序列逐层逆向推理上层意图, 最终逼近父意图的过程。综上所述, 空中目标作战意图的识别任务具有层次性, 作战实体数据具有时序性, 实体状态之间存在双向长时依赖关系。

|

| 图 1 作战意图识别层次图 |

面对上述特性, 本文提出一种层次聚合模型, 自底向上感知作战意图。模型框架如图 2所示, 分为5个部分, 包括数据输入、行为特征感知、意图聚合、意图聚焦以及意图识别。首先, 对描述空中目标实体状态的数据进行处理并将输入数据作为实体特征输入行为特征感知模块, 其次, 通过CNN感知行为特征并向上输入至意图特征聚合模块, 意图特征聚合模块通过Bi-LSTM网络提取子意图之间的双向依赖关系, 之后, 将学习到的特征通过注意力机制聚焦, 最终, 通过softmax函数进行意图识别。

|

| 图 2 空中目标作战意图识别框架 |

对于作战数据, 不同机型的不同特征状态数据差别较大, 需要对其归一化处理来消除量纲影响。具体来说, 作战意图对应的作战动态属性数据有较大波动, 并且一些特征对应的数据范围较大, 如歼击机以最大飞行速度攻击, 其范围可达到2 000 km/h左右, 相比其巡航速度有较大波动; 低空和超高空侦察对应的高度分别为100~1 000 m和15 000 m以上。面对这样的数据特征, 选择Z-score标准化方法将数据归一到均值为0方差为1的分布中, 如(3)式所述。

|

(3) |

式中:μ为所有样本数据的均值;∂为所有样本数据的标准差。

另外, 作战目标特征数据是由不同的传感器在每个时间点上收集的, 代表了目标在某一时刻的状态。因此, 该数据是具有时间特征的序列数据, 它包含了目标的行动序列信息。这种非格式化的时间序列数据需要将其转换为标准格式的数据然后通过CNN提取特征。如图 3所示, 通过滑动窗口对原始数据进行预处理。具体来说, 设置一个80 s的滑动窗口, 以40 s为单位, 每80 s为一个数据片对数据进行切分, 得到的数据片有50%的重叠, 可以保证捕捉到更多的行动细节。这样, 输入的数据被表示为N×W大小的帧切片序列, 其中, N为序列长度, W为特征维度。

|

| 图 3 行为特征感知模块 |

作战行为序列是作战任务分解得到的一系列动作。作战目标为了一定的作战意图需要完成一系列动作以达到某种特定的状态, 如图 1所示, 目标执行一系列行为之后可以达到某种子意图状态。所以, 为了识别目标最终意图, 首先需要从输入数据中提取行为级的特征。为了达成该目的, 本文提出了一个行为特征感知模块用以提取序列数据的行为特征表示。如图 3所示, 该模块由2个卷积层和非线性激活层组成。具体来说, 输入被送入2个一维卷积层, 2个卷积层采用ReLU激活函数激活以提取数据输入中的行为特征。第一层卷积采用128个大小为1×9的卷积核对数据进行卷积操作, 得到特征图后, 第二层采用64个大小为3×9的卷积核进行卷积。之后, 将经过卷积层处理过的数据输入到全连接层。为了防止过拟合, 全连接层后添加一个随机失活层, 通过该层将网络中的神经元随机赋值为零, 以提高网络对数据的影响。

形式上, X=[x1, x2, …, xt]i∈ RN×W为输入特征序列, 行为特征感知模块通过卷积层学习到特征, 该过程可以定义为

|

(4) |

式中:Wc表示权重;bc表示偏移量。

行为特征感知模块学习到底层行为特征表示后, 需要进一步将其送入意图特征聚合模块聚合成子意图特征。

2.3 意图特征聚合模块敌方目标作战意图是随着时间推移不断确定的, 如图 1所示,行为序列组成一系列的子意图, 所以, 这些子意图之间也存在着关联关系。图 4直观展示了子意图之间的依赖关系。对巡逻意图来说, 当作战实体进入巡逻区时, 起飞和非机动飞行是已经发生的状态, 非机动飞行和返回基地是未发生的状态, 只有发生了前面的起飞和非机动飞行才能发生进入巡逻区这个状态, 这是向前的依赖。而反过来说, 作战意图是巡逻, 那必然也会执行后面未发生的状态, 这是向后的依赖。因此, 为了准确识别意图, 在高级特征表示的基础上, 需要更好地表达这种复杂的依赖关系, 同时携带上述双向依赖关系信息进行下一步学习。为了达成该目的, 本文在行为感知层之后提出意图特征聚合模块, 进一步对子意图之间的长距离双向依赖关系进行表示学习。

|

| 图 4 双向依赖关系 |

综上所述, 意图特征聚合模块需要具备从正序和逆序2个方向提取长时依赖关系的全局感知能力, 所以本文采用Bi-LSTM模型对特征进行表达。Bi-LSTM模型由2个方向不同的LSTM单元叠加, 用来提取双向长时依赖关系, 最后将学习到的表达进行拼接形成全局特征。

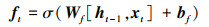

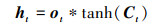

Bi-LSTM的核心是LSTM单元, 其内部构造如图 5所示。首先, 由上一层输出ht-1, 细胞状态信息Ct-1和原始数据x为输入。其中, 细胞状态信息代表了上一层可以添加到下一层的信息。具体上, 如

|

| 图 5 LSTM内部结构 |

图 5的顶层通路所示, 该通路贯穿整个LSTM单元, 通过激活函数sigmoid和点乘单元组成的遗忘门来确定哪些信息得以遗忘, 如公式(5)所示。

|

(5) |

式中: σ为sigmoid激活函数; ht-1是上一层的输出; xt为输入数据。

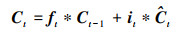

之后, 将状态更新为当前的状态信息Ct,通过sigmoid函数来确定哪些数据保留, 如公式(6)所示;通过tanh函数来确定哪些信息放入新的细胞状态中, 如公式(7)所示。然后结合上一细胞中要忘记的部分和当前需要加入到细胞中的信息来更新细胞状态Ct, 如公式(8)所示。

|

(6) |

|

(7) |

|

(8) |

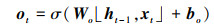

最后, 通过激活函数sigmoid函数过滤信息选择输出的内容ht, 通过点乘输出内容ot与需要输出的细胞状态来实现, 计算过程如公式(9)~(10)所示。

|

(9) |

|

(10) |

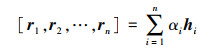

在意图识别过程中, 每一个子意图对识别最终意图的贡献不同, 比如在巡逻意图中, “进入巡逻区”与“离开基地”子意图相比, 对判断作战实体是否在执行巡逻的贡献度更大, 甚至起决定性作用。所以, 为了进一步提高对意图过程的表达能力, 在经过意图特征聚合模块后, 需要对这些特征表示分配不同的权重代表对识别意图的贡献度。具体过程如下:

通过意图特征聚合模块后得到特征表示为[h1, …, hn]∈ RN×W, 基于注意力机制针对每一个hi, 计算出hi与所关注对象的相关程度, 以其作为权重对特征表示整合拼接, 得到最终的表示[r1, r2, …, rn]。计算过程如公式(11)所述。

|

(11) |

式中, αi为权重。

2.5 意图识别模块在完成意图聚焦后, 将带有聚焦并携带全局特征的输入送入前馈神经网络, 压缩至意图识别类别, 再通过softmax函数输出类别的概率。计算过程如公式(12)~(13)所示。

|

(12) |

|

(13) |

因为作战意图识别实际上是分类任务, 所以选择softmax将输出表示为概率的形式, 交叉熵(cross-entropy loss)作为损失函数衡量损失, 优化器Adam[20]对损失最小化。softmax和交叉熵结合学习类别之间的信息并对正确标签预测准确概率进行评估[21]。Adam优化算法参数采用默认参数, β1=0.9, β2=0.999, 初始学习率设置为α=0.001。

3 实验为了验证所提出的层次聚合模型对作战意图的识别能力, 首先, 在空中目标意图数据集上训练模型。然后, 设计对比实验证明本文方法的优越性, 将所提出模型与现有的一些简单且高效的基线模型的识别准确率进行对比。最后, 分别对行为特征感知、意图特征聚合以及意图聚焦3个模块设计消融实验验证模型各个模块的有效性。

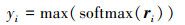

3.1 模型训练与战术意图识别结果将模型在空中目标意图数据集上训练, 该数据集规模为带标签数据27 452条, 包括战斗机的6种战术任务, 即巡逻、侦察、攻击、突防、规避和巡航。对样本数据进行切分得到数据片, 由这些数据片组成样本集。取70%为训练集, 30%为测试集。以混淆矩阵的方式呈现模型识别结果。如图 6所示, 可以直观地看出混淆矩阵的对角线颜色较深, 说明模型可以达到比较好的分类效果。进一步地, 分析混淆矩阵的结果可以得到, 6类意图中, 攻击、突防分类效果最好, 这是由于这两类意图的辨识度较高。

|

| 图 6 层次聚合感知模型混淆矩阵 |

其中, 攻击意图虽然样本数量只有353条, 但分类全部正确。而相反巡逻、规避与巡航3个意图相似性较高, 没有攻击与突防的识别效果好。其中, 巡逻意图有59条被预测为规避, 57条被误分类为巡航。规避和巡航分别有100条和99条被误分类为巡逻。而对于侦察意图, 虽然辨识度不高, 但是样本数量大, 所以分类效果也不错, 但还是有部分样本被预测为巡航、巡逻与规避。

3.2 模型评估为了验证所提模型的优势, 本文对比了当前基于深度学习的意图识别模型, 包括周旺旺等所采用的DNN[13], 赵佳欢等所采用的RNN[15]以及王志刚等所采用的LSTM[17]。进一步地, 也对比了一些高效且简单的基线模型, 包括CNN[22]、GRU[23]以及Transformer[24]。将各个模型在空中目标意图数据集上训练, 每个模型训练5次。公平起见, 将空中目标意图数据进行相同的预处理, 并以相同的划分输入到上述模型中进行意图识别, 最终将识别的各项评价指标与本文所提出的模型进行对比。结果如表 1所示。

由对比实验可知, 传统的深度神经网络模型由于增加深度会造成局部最优的问题, 并且没有考虑到战场作战数据的时序性特点, 所以难以达到较好的拟合效果; 卷积神经网络模型虽然采用权值共享和局部连接结构可以减少学习参数并提取局部特征, 但由于也无法对时间序列上的变化进行建模, 所以准确率也不是很好; 循环神经网络可以学习时间序列信息, 但标准循环神经网络无法学习长时间依赖信息, 而对于意图识别场景, 作战数据之间包含长时的关联关系, 该关系反映了子意图之间的依赖。所以, 提取长时依赖关系的循环神经网络变体LSTM与GRU模型可以更好地表达意图识别场景。为了在空中目标意图识别任务上达到更好的识别效果, 本文所提出的层次聚合模型结合作战过程中敌方作战意图识别场景的特点, 双向学习全局特征, 实验表明可以达到89.16%的F1值, 在所有模型中识别率最好, 证明本文模型具有在复杂战场情况下准确识别敌方目标意图的能力。

3.3 模型分析为了验证所提模型各个模块的有效性, 设计3组消融实验验证每个模块添加前后对作战意图识别准确率的影响。分别将底层行为特征感知模块、意图特征聚合模块与意图聚焦模块移除, 将移除以后的模型在空中目标意图数据集上训练并测试识别意图准确率, 以验证每个模块对模型识别准确率的影响, 确定模块有效性。

不同模块消融实验的结果如表 2所示, 从该表可以看出, 移除行为特征感知模块之后, 在测试集上的准确率仅为82.1%, F1值为83.12%, 相比于原模型, 识别性能有大幅下降。移除了意图聚合模块之后, 模型在测试集上的准确率为84.48%, F1值为84.41%, 相比于原模型, 性能有所下降, 但与移除行为特征感知模块性能的降幅相比要相对低一些。移除了意图聚焦模块之后, 在测试集上的准确率为86.95%, F1值为87.39%, 相比于原模型, 性能下降了2%左右, 相比于上面2个消融实验的结果, 显然意图聚焦模块的存在对模型结果的影响最小。

| 行为特征感知模块 | 意图特征聚合模块 | 意图聚焦模块 | 准确率/% | F1值/% |

| × | √ | √ | 82.10 | 83.12 |

| √ | × | √ | 84.48 | 84.41 |

| √ | √ | × | 86.95 | 87.39 |

| √ | √ | √ | 88.83 | 89.16 |

3组消融实验的混淆矩阵结果如图 7所示, 其中图 7a)为移除行为特征感知模块的实验结果, 从混淆矩阵看出, 对角线上的正确结果相对降低。结合表 2的结果, 可以证明消除了机动性特征后, 极度降低了模型表示能力。这说明, 对基本的机动行为特征的学习对识别最终作战意图至关重要。这是由于目标的机动行为构成了最基本的飞行行为, 所以对机动行为的感知是识别作战意图的前提。行为感知模块通过滤波器在时序数据中提取行为的特征, 这个操作中不同大小的卷积核在数据上滑动以感知低级的行为, 将这些行为表达送入上层继续学习可以提高模型表达能力, 这是符合观察行为细节以判断整体意图的基本逻辑的。

|

| 图 7 各个模块消融实验结果 |

图 7b)为移除了意图聚合模块的混淆矩阵, 结论与表 2数据一致。性能有所下降原因是意图聚合模块的主要功能为感知和表达子意图之间的双向依赖关系, 这可以为推断意图提供更多的信息, 但它不是确定意图的关键信息。

图 7c)为移除了意图聚焦模块的混淆矩阵, 该矩阵与原模型效果相差最小。出现该结果的原因是意图聚焦模块对识别意图来说能提供的信息对模型表达能力影响最小, 该模块的主要作用是对已学习到的特征表示分配权重, 以影响作战实体最终意图的表示, 所以是对已学习到的关键信息加以补充, 但不是决定性信息。

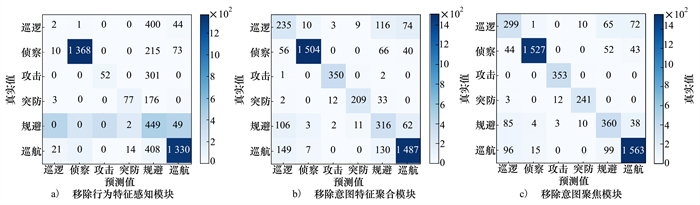

3.4 参数影响在本节, 分析了模型各个模块参数的不同设置对模型表现的影响, 其中包括行为感知模块中的卷积层数和卷积核大小, 意图特征聚合模块中的双向长短时记忆单元数。实验结果如图 8所示, 图 8a)展示了卷积层数对模型准确率的影响。双层卷积层的性能最好, 进一步增加层数会增加模型的复杂性, 导致过拟合使得模型性能下降。图 8b)展示了卷积核大小的影响。实验结果表明空中目标意图数据集需要更多的卷积核才能达到最佳的识别能力, 这是因为增加卷积核的数量可以感知到更多的行为特征。另外, Bi-LSTM单元的数量也会影响性能, 实验结果如图 8c)所示, 模型中需要较少的单元来感知双向依赖, 最佳单位数为32。进一步增加单元的数量也会增加模型的复杂性, 并导致过拟合, 使得模型性能下降。

|

| 图 8 参数实验结果 |

1) 面对空中目标作战意图任务的层次性和分解的子意图序列具有长时相互依赖的特点, 提出一种层次聚合模型以识别目标作战意图。

2) 通过数据驱动的方法解决传统作战意图识别中过于依赖领域专家知识进行决策的问题, 并对比分析了各个神经网络模型在该任务上的性能。

3) 与传统方法相比, 本文方法减少了人工成本以及对专家领域知识的依赖, 与标准深度神经网络和标准循环神经网络相比, 解决了无法利用长时全局依赖关系以及特征聚焦的问题。通过消融实验验证了所提模型各个模块的有效性。

在未来的工作中, 将针对相似意图分类效果不明显的问题进一步改进模型, 后续将开展多通道模型的研究以增强模型表达能力, 从而提取空中目标意图数据集中更丰富的信息。

| [1] | NOBLE D F. Schema-based knowledge elicitation for planning and situation assessment aids[J]. IEEE Trans on Systems, Man, and Cybernetics, 1989, 19(3): 473-482. DOI:10.1109/21.31054 |

| [2] |

黄长强. 未来空战过程智能化关键技术研究[J]. 航空兵器, 2019, 26(1): 11-19.

HUANG Changqiang. Research on key technology of future air combat process intelligentization[J]. Aero Weaponry, 2019, 26(1): 11-19. (in Chinese) |

| [3] |

赵福均, 周志杰, 胡昌华, 等. 基于置信规则库和证据推理的空中目标意图识别方法[J]. 电光与控制, 2017, 24(8): 15-19.

ZHAO Fujun, ZHOU Zhijie, HU Changhua, et al. Aerial target intention recognition approach based on belief-rule-base and evidential reasoning[J]. Electronics Optics & Control, 2017, 24(8): 15-19. (in Chinese) |

| [4] | JIANG W, HAN D, FAN X, et al. Research on threat assessment based on Dempster-Shafer evidence theory[J]. Lecture Notes in Electrical Engineering, 2012, 113: 975-984. |

| [5] | BASIR O, YUAN X. Engine fault diagnosis based on multi-sensor information fusion using Dempster-Shafer evidence theory[J]. Information Fusion, 2007, 8(4): 379-386. DOI:10.1016/j.inffus.2005.07.003 |

| [6] |

谢泓, 蒲金龙. 基于D-S证据理论多模复合探测器信息融合算法研究[J]. 光电技术应用, 2017, 32(2): 41-43.

XIE Hong, PU Jinlong. Research on information fusion method of multi-sensor based on Dempster-Shafer evidence theory[J]. Electro-Optic Technology Application, 2017, 32(2): 41-43. (in Chinese) DOI:10.3969/j.issn.1673-1255.2017.02.008 |

| [7] |

葛顺, 夏学知. 用于战术意图识别的动态序列贝叶斯网络[J]. 系统工程与电子技术, 2014, 36(1): 76-81.

GE Shun, XIA Xuezhi. DSBN used for recognition of tactical intention[J]. Systems Engineering and Electronics, 2014, 36(1): 76-81. (in Chinese) |

| [8] | QING J, XIANTAI G, WEIDONG J, et al. Intention recognition of aerial targets based on Bayesian optimization algorithm[C]//2nd IEEE International Conference on Intelligent Transportation Engineering, 2017: 356-359 |

| [9] |

李战武, 李双庆, 彭明毓, 等. 基于注意力机制改进的LSTM空战目标意图识别方法[J]. 电光与控制, 2023, 30(3): 1-7.

LI Zhanwu, LI Shuangqing, PENG Mingyu, et al. Air combat intention recognition method of target based on LSTM improved by attention mechanism[J]. Electronics Optics & Control, 2023, 30(3): 1-7. (in Chinese) |

| [10] | ABDULGHANI Ali Ahmed, MOHAMMED Falah. SAIRF: a similarity approach for attack intention recognition using fuzzy min-max neural network[J]. Journal of Computational Science, 2018, 25: 76-81. DOI:10.1016/j.jocs.2018.02.007 |

| [11] |

陈浩, 任卿龙, 滑艺, 等. 基于模糊神经网络的海面目标战术意图识别[J]. 系统工程与电子技术, 2016, 38(8): 1847-1853.

CHEN Hao, REN Qinglong, HUA Yi, et al. Fuzzy neural network based tactical intention recognition for sea targets[J]. Systems Engineering and Electronics, 2016, 38(8): 1847-1853. (in Chinese) |

| [12] | ZHAO Kexin, HUANG Changqiang. The Hierarchical recognition method of autonomous air tactical operation of unmanned combat aircraft[C]//Proceedings of the 7th International Conference on Informatics, Environment, Energy and Applications, 2018: 129-133 |

| [13] |

周旺旺, 姚佩阳, 张杰勇, 等. 基于深度神经网络的空中目标作战意图识别[J]. 航空学报, 2018, 39(11): 195-203.

ZHOU Wangwang, YAO Peiyang, ZHANG Jieyong, et al. Combat intention recognition for aerial targets based on deep neural network[J]. Acta Aeronautica et Astronautica Sinica, 2018, 39(11): 195-203. (in Chinese) |

| [14] | ZAREMBA W, SUTSKEVER I, VINYALS O. Recurrent neural network regularization[C]//International Conference on Learning Representations, 2015 |

| [15] |

赵佳欢, 杨海明, 邱令存. 基于循环神经网络的空中目标类型识别[J]. 航天控制, 2020, 38(3): 47-53.

ZHAO Jiahuan, YANG Haiming, QIU Lingcun. Recognition of aerial target types based on recurrent neural network[J]. Aerospace Control, 2020, 38(3): 47-53. (in Chinese) |

| [16] | ZHANG H, ZHU T. Aircraft hard landing prediction using LSTM neural network[C]//2nd International Symposium on Computer Science and Intelligent Control, 2018: 1-5 |

| [17] |

王志刚, 王业光, 杨宁, 等. 基于LSTM的飞行数据挖掘模型构建方法[J]. 航空学报, 2021, 42(8): 262-271.

WANG Zhigang, WANG Yeguang, YANG Ning, et al. Construction method of flight data mining model based on LSTM[J]. Acta Aeronautica et Astronautica Sinica, 2021, 42(8): 262-271. (in Chinese) |

| [18] |

欧微, 柳少军, 贺筱媛, 等. 基于时序特征编码的目标战术意图识别算法[J]. 指挥控制与仿真, 2016, 38(6): 36-41.

OU Wei, LIU Shaojun, HE Xiaoyuan, et al. Tactical intention recognition algorithm based on encoded temporal features[J]. Command Control & Simulation, 2016, 38(6): 36-41. (in Chinese) |

| [19] | SCHUSTER M, PALIWAL K. Bidirectional recurrent neural networks[J]. IEEE Trans on Signal Processing, 1997, 45(11): 2673-2681. |

| [20] | KINGMA D P, BA J. Adam: a method for stochastic optimization[C]//International Conference on Learning Representations, 2015 |

| [21] | DENG J, GUO J, XUE N, et al. ArcFace: additive angular margin loss for deep face recognition[C]//2019 IEEE/CVF Conference on Computer Vision and Pattern Recognition, 2019: 4685-4694 |

| [22] | KIM Y. Convolutional neural networks for sentence classification[C]//Conference on Empirical Methods in Natural Language Processing, 2014: 1746-1751 |

| [23] | CHO K, MERRIENBOER B V, GULCEHRE C, et al. Learning phrase representations using RNN encoder-decoder for statistical machine translation[C]//Proceedings of the 2014 Conference on Empirical Methods in Natural Language Processing, 2014: 1724-1734 |

| [24] | VASWANI A, SHAZEER N, PARMAR N, et al. Attention is all you need[C]//Proceedings of the 31st International Conference on Neural Information Processing Systems, 2017: 5998-6008 |

2. School of Software, Northwestern Polytechnical University, Xi'an 710072, China