2. 中国船舶科学研究中心 深海载人装备国家重点实验室, 江苏 无锡 214082

目前, 视觉信息已经被广泛用于陆、空机器人的自主控制, 如: 自动驾驶、无人机目标跟踪等[1-2]。然而, 由于水下环境的复杂性以及光在水下的严重衰减和散射, 影响了水下相机的有效作用距离, 使得单幅水下图像存在有效视场小、目标场景信息少的问题[3], 限制了视觉图像信息在无人水下潜水器(UUV)自主作业任务中的应用。因此, 研究有效的水下多帧目标图像拼接融合方法, 在不损失分辨率的同时增加视野宽度, 对实现基于视觉信息驱动的UUV水下自主作业任务具有重要的意义。

图像拼接融合是计算机视觉领域中研究的热点内容之一, 将具有相同部分特征或区域的多帧图像, 在不损失图像分辨率的前提下, 拼接融合成一幅平滑的、匹配准确的大尺度场景图像[4]。近年来, 基于尺度不变特征变换的匹配算法(SIFT)、基于加速稳健特征的匹配方法(SURF)及其相关改进方法[5]因具有旋转不变性、缩放不变性等优点被广泛应用于拼接图像的特征点提取与匹配。虽然这些方法对空气中的图像能够获得很好的拼接融合效果, 但由于水下图像的大量特征被水体掩盖[6-8], 无法直接采用上述方法提取足够多的有效特征点匹配对数来实现水下图像的拼接融合。为了解决这一问题, 大量的学者通过研究水下图像增强方法来提高水下图像质量, 增加有效的特征点匹配对数, 以获得更好的图像拼接效果, 如: 余俊[9]在传统滤波增强水下图像的基础上, 利用基于SIFT的特征点匹配方法实现了不错的图像拼接融合效果; 王昕平等[10]采用多尺度融合的方法增强水下图像, 以提高水下图像的特征点对数, 并在此基础上通过一种改进的SIFT特征匹配方法进行水下图像的拼接融合; Raut等[11]在SIFT算法的基础上采用Gabor滤波器抑制水下图像噪声, 并采用Hausdorff距离进行关键特征点对的匹配, 实现了水下图像的拼接融合; 姚博文[12]在图像预处理的基础上, 在特征点处加入纹理特征, 并利用SURF算法和感知哈希算法实现对水下图像序列的拼接融合。虽然这些方法能够在一定程度上实现对水下图像的拼接融合, 但对于模糊和颜色畸变严重的水下图像的拼接融合效果不理想, 存在应用场景单一、计算复杂度高、特征点匹配对数少的不足。

为了实现更高效的水下图像拼接融合, 本文提出了一种基于自适应图像增强的水下多帧目标图像拼接融合方法, 在基于图像模糊的自适应水下图像增强方法的基础上, 利用改进的SURF方法和渐入渐出融合策略实现水下的拼接融合。试验结果表明, 相比于当前的几种方法, 本文所提的方法在有效增加特征点匹配对数的同时提升了图像的拼接质量。

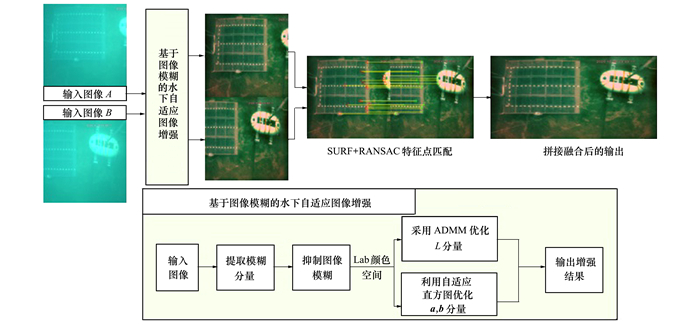

1 本文算法为了增加图像拼接过程中特征点的有效匹配对数, 提高水下图像拼接质量, 本文提出一种基于自适应图像增强的水下多帧目标图像拼接融合方法。首先, 结合图像的模糊先验估计透射率, 并利用交替方向乘子法(ADMM)和自适应直方图方法抑制水下图像的模糊与颜色畸变, 实现了对水下图像的增强; 然后, 提取增强后水下图像的SURF特征点进行匹配, 并利用RANSAC进一步提纯后计算仿射变换矩阵; 最后, 采用渐入渐出融合策略抑制了拼接后的图像存在缝隙明显、亮度差异较大的现象。本文算法流程如图 1所示。

|

| 图 1 本文算法流程图 |

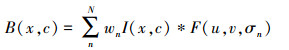

水下图像的清晰度与相机至目标的距离呈负相关, 距离越大, 相机捕获的水下图像越模糊, 由此, 可利用图像的模糊先验估计光在水下传播的透射率来消除水下图像的模糊。图像的模糊分量B(x, c)可采用多尺度高斯环绕函数F(u, v, c)进行估计, 即

|

(1) |

式中:I(x, c)为输入的初始水下图像; x=(u, v)表示像素点坐标; c∈(R, G, B)表示图像的某一颜色通道; N为选择的尺度数; σn为相应尺度的权重系数; *表示卷积操作;相关参数通常可设置为:N=3, w1=0.5, w2=0.4, w3=0.1, σ1=15, σ2=80, σ3=200。

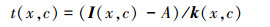

结合基于模糊的透射率估计模型, 可得

|

(2) |

式中:k(x, c)=(I(x, c)-A·B(x, c))/B(x, c)是与图像模糊分量相关的系数矩阵; A为背景光值, 采用基于暗通道先验的方法进行估计。

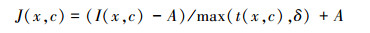

当得到透射率后, 利用Jaff-McGlamery成像模型即可获得去模糊后的水下图像J(x, c), 函数表达式为

|

(3) |

式中, δ=0.01为t(x, 0)的下边界, 防止当t(x, c)→0时J(x, c)→∞。

对于去模糊后的水下图像仍旧存在的颜色畸变和亮度不均匀问题, 首先将去模糊后的水下图像转换到Lab颜色空间, 以L分量作为初始光照分量

|

(4) |

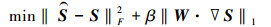

式中, β是系数(默认值取0.09), W=1/(∇S+γ)是权重矩阵, γ=0.001表示∇S的下边界, 防止当∇S→0时W→∞; ∇S是S的一阶导数。以∇S=Z作为约束, (4)式可以写成增广拉格朗日的形式

|

(5) |

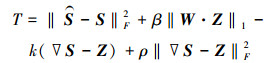

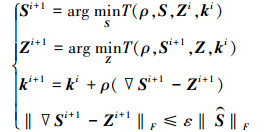

式中:k为增广拉格朗日乘子;ρ为增广拉格朗日参数, 且ρ>0;通过构建迭代函数, 采用ADMM求解光照分量的优化结果S, 迭代函数如(6)式所示。

|

(6) |

式中, ε为迭代终止条件的常系数, 一般取ε≤10-4。

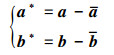

通过对清晰图像的统计分析发现, Lab颜色空间中的a, b分量的直方图大多分布在零值附近, 即可采用自适应直方图方法重新调整a, b分量的直方图分布, 函数表达式如(7)式所示。

|

(7) |

式中:a, b分别为a, b分量的均值; a*, b*分别为a, b调整后的分量值。

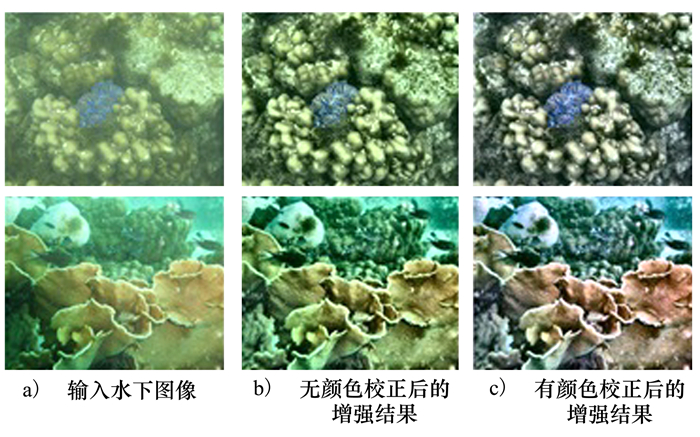

然后, 再将S, a*, b*转换到RGB颜色空间即可获得整体增强后的水下图像。有/无颜色校正后的结果如图 2所示。由对比结果可知, 颜色校正后的增强结果具有更好的效果。

|

| 图 2 有/无颜色校正后的对比结果 |

SURF算法是一种基于SIFT的改进方法, 在保留SIFT的旋转不变性、尺度缩放不变性、亮度变化不变性等基础上, 改进了对特征的提取和描述方式, 提高了算法的计算效率和鲁棒性。SURF算法基本流程主要包括: 生成Hessian矩阵为特征点的提取提供稳定的边缘特征点, 利用盒式滤波器构建多尺度空间金字塔, 特征点定位, 利用Harr小波变换为特征点方向分配, 生成特征点描述子和特征点匹配。

在特征点匹配过程中, SURF算法通常采用欧氏距离计算2个特征点描述子之间的匹配度, 距离越短, 表示2个特征点的匹配度越高。然而, 仅采用欧氏距离作为匹配度指标存在误匹配率较高的问题。针对该问题, 考虑到特征点描述子是一个高维向量的特点, 本文采用两特征点之间的余弦距离作为约束来降低匹配误差, 这是由于余弦距离可以很好地衡量2个特征点的描述子方向的差异。余弦距离的表达式如(8)式所示。

|

(8) |

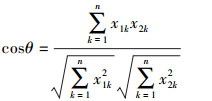

式中:x1k, x2k分别为2个特征点的特征描述子; n表示特征描述子的向量维数, 取n=64。余弦值越大表示两特征描述子的方向差异越小。

然后, 采用欧氏距离进行关键点的粗匹配, 最后, 在粗匹配的基础上, 利用RANSAC算法对匹配点进行提纯以剔除误匹配点。

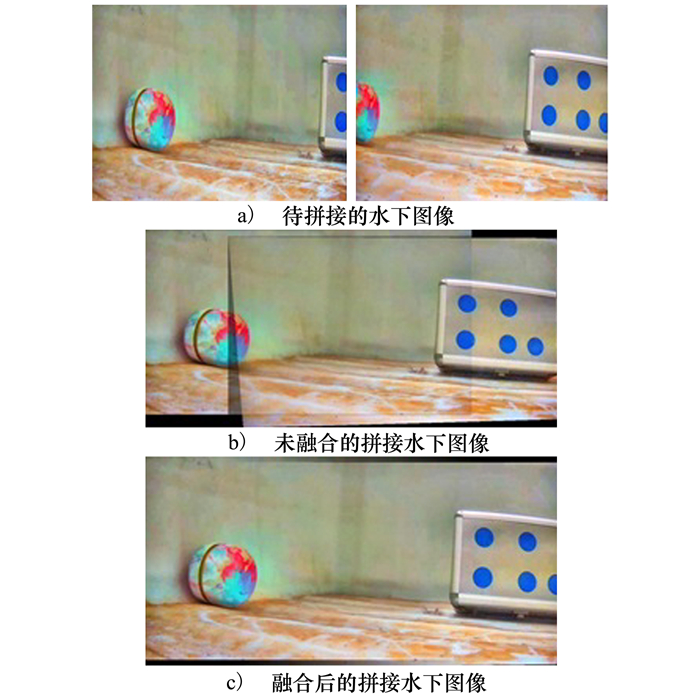

1.3 渐入渐出融合策略利用特征点匹配对计算出仿射变换矩阵后即可实现多帧图像的拼接任务, 然而, 此时的拼接结果存在缝隙明显、亮度差异较大的问题。为了获得一幅平滑的大尺度场景图像, 采用渐入渐出的融合策略来抑制拼接处缝隙明显、亮度差异较大的现象。

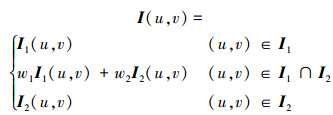

渐入渐出融合是一种加权平均的融合策略, 是对待融合图像重叠区域的像素采用加权平均的方式来抑制曝光差异和拼接缝隙, 函数表达式如(9)式所示。

|

(9) |

式中:I1(u, v), I2(u, v)分别为2幅待融合的图像;I(u, v)为融合后的图像;w1和w2为权重系数, w1, w2∈[0, 1]且w1+w2=1。有/无渐入渐出融合策略的拼接结果如图 3所示。由对比结果可知, 采用渐入渐出融合策略能够很好地解决拼接后的图像缝隙明显、亮度差异较大的问题。

|

| 图 3 有/无渐入渐出的融合策略的拼接结果 |

为了验证本文所提方法的有效性, 分别从3个方面进行了对比试验: ①增强前后图像拼接融合结果对比; ②与当前几种水下图像拼接融合方法的对比; ③多帧目标图像拼接融合的水池试验。

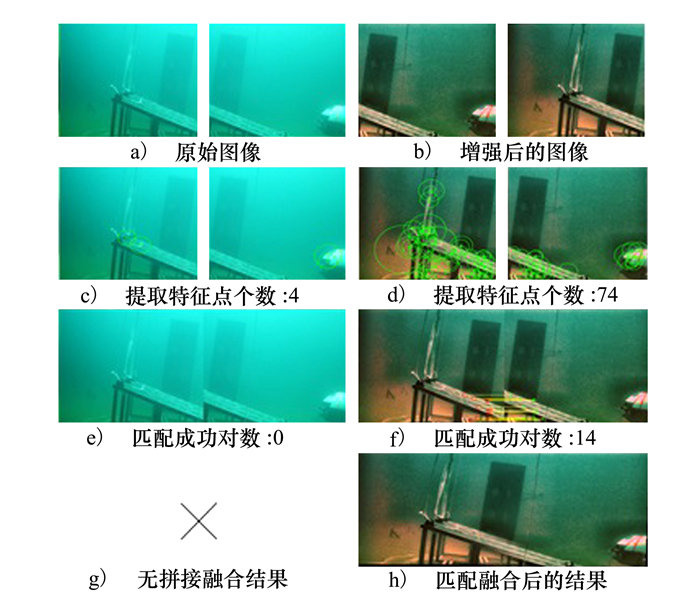

2.1 增强前后图像拼接融合结果对比采用来自某研究所深水池的两相关帧图像进行对比试验, 对比分析利用本文所提方法增强前后水下图像拼接融合的效果, 对比结果如图 4所示。

|

| 图 4 无/有图像增强后水下图像拼接融合结果 |

从图 4可知, 原始水下图像虽然颜色畸变严重, 但仍能检测出4个特征点, 说明SURF算法鲁棒性较强。然而, 成功匹配的特征点对数却是0对, 无法实现后续的拼接融合。利用本文所提方法增强后的水下图像检测到74个特征点, 匹配成功14对, 最终获得较为平滑的拼接融合结果, 这表明本文所提方法能够有效增加特征点匹配对数, 并能实现较好的水下图像拼接融合效果。

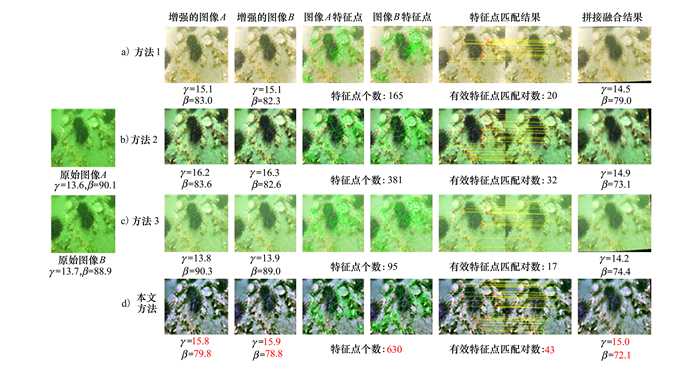

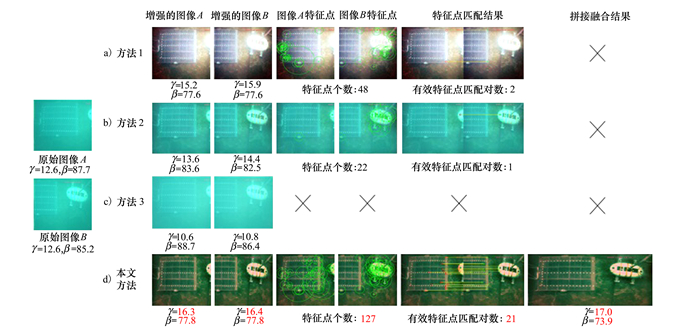

2.2 与当前几种方法的对比试验为了验证本文所提方法的先进性, 将所提方法与方法1[10]、方法2[9]和方法3[11]进行比较, 并采用图像信息熵(γ)和峰值信噪比(β)作为评价指标对增强后的结果和拼接融合后的结果进行客观分析。对比试验采用2组不同水域的图像, 其中: 第一组采用的图像来自某竞赛数据集(见图 5); 第二组采用的图像来自某研究所深水池(见图 6)。

|

| 图 5 第一组图像增强及拼接融合对比结果(红色标记数据代表了最优的结果) |

|

| 图 6 第二组图像增强及拼接融合对比结果(红色标记数据代表了最优的结果, ×表示无特征点提取/拼接融合结果) |

由图 5可知, 方法1和方法2能够在一定程度上提高水下图像质量, 但方法1仍存在模糊问题, 方法2获得的结果呈蓝色调, 存在颜色畸变; 方法3的整体增强效果比较差, 虽然能微弱地抑制颜色畸变, 但模糊问题更加突出; 本文所提方法在抑制模糊和颜色畸变方面均表现出较好的效果, 并且具有最好的评价指标值, 这表明本文所提的基于图像模糊的自适应水下图像增强方法具有比较理想的效果。另外, 利用本文方法在实现拼接融合过程中, 增加了提取的特征点个数及有效的特征点匹配对数, 最后获得的拼接融合结果具有更高的图像质量。

由图 6可知, 除本文方法外, 另外3种对比方法均无法实现对该场景下目标图像的拼接融合, 这是由于相比于第一组试验场景, 该组试验使用的图像采集于更深的水域, 图像的模糊和颜色畸变问题更突出, 对于图像增强方法的性能、泛化能力提出了更高的要求。方法1虽然能一定程度上改善图像质量, 但该算法对光照的不均匀性敏感, 导致增强后的结果不理想, 仅能获得2对有效特征点匹配对, 无法实现该场景下的拼接; 相比于方法3, 方法2能够在一定程度上抑制水下图像的模糊, 但增强后的图像仍无法获得足够的有效特征点匹配对数(仅1对), 无法实现该场景下的拼接; 本文方法能够有效地提高图像质量, 具有稳定的图像增强效果, 同时从增强后的图像中成功匹配了21对有效特征点, 实现了该场景下高质量的图像拼接融合效果。

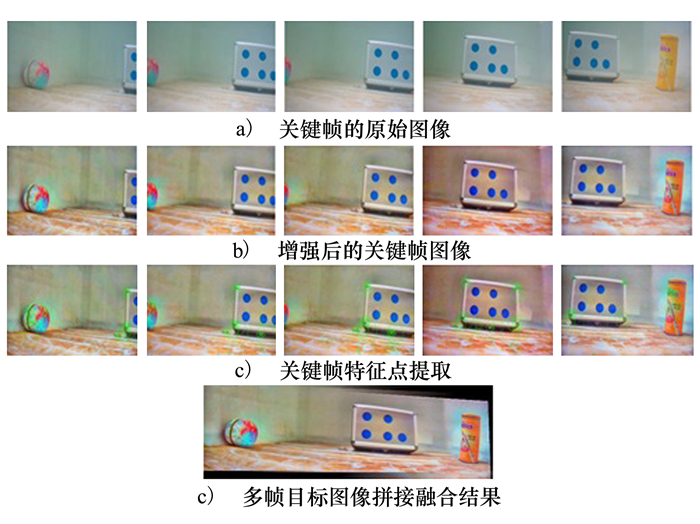

2.3 多帧目标图像拼接融合的水池试验为了进一步验证本文方法在多帧目标图像拼接融合过程中的有效性, 通过布置水池试验环境, 完成了对算法性能的验证。

水下相机性能及设定参数: 高清水下网络相机(型号: GDSK-FEHD-CAM), 图像分辨率: 1 920×1 080, 帧频设置: 10 frame/s, 视频采集时间: 20 s。按照间隔为40 frame/s时提取1幅图像作为关键帧, 共提取5帧图像作为关键帧用来进行图像拼接融合。拼接融合结果如图 7所示。

|

| 图 7 多帧水下目标图像拼接融合结果 |

从图 7可知, 本文所提出的基于自适应图像增强的水下多帧目标图像拼接融合方法, 能实现对水下多帧目标图像的特征点提取与匹配, 拼接融合后的图像能有效抑制亮度差异和拼接缝隙, 可弥补单幅水下图像存在有效视场小、目标场景信息少的缺点。

3 结论针对水下图像拼接融合过程, 有效特征点匹配对数不足和拼接融合图像质量低的问题, 提出了一种基于自适应图像增强的水下多帧目标图像拼接融合方法。该算法利用图像模糊先验获得去模糊的水下图像, 然后将去模糊后的图像转换到Lab颜色空间, 并分别利用ADMM和自适应直方图方法校正L分量和a, b分量来抑制水下图像的颜色畸变, 获得最终增强后的清晰图像; 在此基础上, 将余弦距离作为约束条件引入SURF算法, 降低了匹配误差; 最后采用渐入渐出融合策略实现了高质量的水下图像拼接融合效果。试验结果表明, 相较于其他几种算法, 本文提出的方法在有效地提高水下图像的质量的同时, 增加了有效特征点匹配对数, 提升了拼接效果。

| [1] | RAO Y, YANG F. Research on path tracking algorithm of autopilot vehicle based on image processing[J]. International Journal of Pattern Recognition and Artificial Intelligence, 2019, 5(34): 1-15. |

| [2] | WANG S, JIANG F, ZHANG B, et al. Development of UAV-Based target tracking and recognition systems[J]. IEEE Trans on Intelligent Transportation Systems, 2019, 21(8): 3409-3422. |

| [3] | PAUL S, DURGAM U K, PATI U C. Progress in intelligent computing techniques: theory, practice and applications[M]. Singapore: Springer, 2018: 123-129. |

| [4] |

唐松奇. 基于卷积神经网络的水下图像增强与拼接方法研究[D]. 哈尔滨: 哈尔滨工程大学, 2020 TANG Songqi. Research on underwater image enhancement and stitching method based on convolutional neural network[D]. Harbin: Harbin Engineering University, 2020(in Chinese) |

| [5] | RUBLEE E, RABAUD V, KONOLIGE K, et al. ORB: an efficient alternative to SIFT or SURF[C]//IEEE International Conference on Computer Vision, 2011: 2564-2571 |

| [6] | ZHUO Li, HU Xiaochen, LI Jiafeng. A naturalness-preserved low-light enhancement algorithm for intelligent analysis[J]. Chinese Journal of Electronics, 2019, 28(2): 316-324. DOI:10.1049/cje.2018.12.004 |

| [7] | ZHANG W B, LIU W D, LI L, et al. An adaptive color correction method for underwater single image haze removal[J]. Signal, Image and Video Processing, 2022, 16(4): 1003-1010. DOI:10.1007/s11760-021-02046-6 |

| [8] | LI L, WANG R, WANG W, et al. A low-light image enhancement method for both denoising and contrast enlarging[C]//IEEE International Conference on Image Processing, Quebec City, 2015: 3730-3734 |

| [9] |

余俊. 基于SIFT的水下图像拼接算法研究[D]. 杭州: 杭州电子科技大学, 2020 YU Jun. Research on underwater image stitching algorithm based on SIFT[D]. Hangzhou: Hangzhou University of Electronic Science and Technology, 2020 |

| [10] |

王昕平, 张森林, 刘妹琴, 等. 基于多尺度图像融合和SIFT特征的水下图像拼接研究[J]. 计算机应用与软件, 2021, 38(5): 213-217.

WANG Xinping, ZHANG Senlin, LIU Meiqin, et al. Research on underwater image stitching based on multi-scale image fusion and SIFT features[J]. Computer Applications and Software, 2021, 38(5): 213-217. (in Chinese) DOI:10.3969/j.issn.1000-386x.2021.05.034 |

| [11] | RAUT S, PATI U C. Underwater image registrtion with improved SIFT algorithm[C]//2017 2nd IEEE International Conference on Recent Trends in Electronics, Information and Communication Technology, 2017: 1237-1241 |

| [12] |

姚博文. 面向AUV应用的水下图像清晰化处理和拼接技术的研究[D]. 杭州: 浙江大学, 2019 YAO Bowen. Research on underwater image sharpening processing and stitching technology for AUV applications[D]. Hangzhou: Zhejiang University, 2019(in Chinese) |

2. State Key Laboratory of Deep-Sea Manned Vehicles, China Ship Scientific Research Center, Wuxi 214082, China