2. 西安卫星测控中心, 陕西 西安 710043

图像匹配技术是图像处理中一个很重要的方向。在机器识别的过程中,常需要把不同传感器在不同时间、不同成像条件下对同一景物获取的2幅或者多幅图像进行空间上对准,或是根据已知的模式到另一幅图中找到相应的模式,这就需要用到图像匹配[1]。

图像匹配中,最接近人类视觉的方法就是利用物体的形状特征进行匹配。在计算机中物体形状的描述可以分为基于全局特征和局部特征2大类,全局特征主要包括:颜色、纹理、边缘等;局部特征主要有角点、SURF特征等[2]。边缘[3]与角点[4]是对应的2种典型代表。图像边缘是一种典型的全局特征,计算方便,大大压缩了图像的数据量,但无法区分目标与背景。角点作为局部特征的代表,具有很强的形状区分能力,能准确定位图像细节,但易受噪声干扰。

现有的图像匹配算法大都忽略感兴趣区域而对图像进行全局处理,如SIFT算法、相位相关法、基于小波变换[5]的图像匹配算法等,根据全局处理结果按照一定规律进行匹配[6],这类处理方法过程易于实现但不适用本文研究对象。本文的研究对象红外图像轮廓模糊,内部细节几乎不可见,使用SIFT等方法无法找到匹配的目标点;而可见光图像中背景信息多,目标与背景的区别不明显。本文算法利用了2种图像的差异性,快速提取红外目标并以此为基础寻找可见光目标,从而加快匹配速度,提高匹配准确性。

1 算法流程本文的基于边缘与角点相结合的目标提取与匹配算法,以边缘简单的红外图像为参考,提取可见光中目标区域,再进行匹配。因为红外图像和可见光图像的信息差异,采用不同的方法分别处理。红外图像采用OTSU阈值处理,去除背景信息;再用傅里叶描述子重建边界,提取目标边缘。对可见光图像进行Canny边缘检测,形态学操作等步骤,使图像边缘连通并尽量去掉多余的背景信息。下一步利用红外边缘图像的初始角点,在可见光边缘图像中搜索待匹配区域并提取目标区域。最后根据目标的不同特性,主要采用不变矩、欧氏距离或傅里叶描述子方法进行相似性度量,并将实验结果与基于傅里叶描述子方法[7]和CSS[8]方法进行对比,本文方法准确率平均87%,高于其他2种方法的68%和74%,同时计算效率优于傅里叶描述子方法。

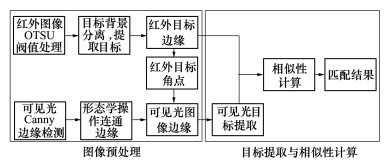

图 1为本文算法流程图。红外图像的对比度较低,热源目标与背景的差异较大,边缘简单,易于提取目标;可见光图像与红外图像相比,背景信息复杂,目标背景难以区分,但图像细节信息丰富。利用红外与可见光图像的信息差异,以边缘简单的红外图像为参考,提取可见光中目标区域,进行相似性计算,获得匹配结果。

|

| 图 1 图像匹配流程图 |

根据图 1,提取待匹配目标区域之前,根据红外与可见光图像的不同特点采用了不同的预处理方法。采用基于OTSU方法[9]的阈值处理将红外图像中目标与背景分离,本文研究的红外图像直方图基本为单峰,OTSU方法对类间方差为单峰的图像产生较好的分割效果。在OTSU阈值处理部分可能将一些干扰背景也作为目标,为了结果更为准确,在图像中标记8连通分量,仅保留大的连通区域,得到目标与背景分离的目标区域。最后使用傅里叶描述子重建边界,获得包含目标边缘的最小窗口。对此窗口图像进行Harris角点检测,寻找红外目标上的全部角点。

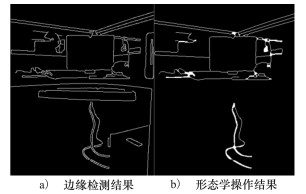

对可见光图像,应该尽可能增强目标边缘信息而弱化背景边缘,如图 2所示。

|

| 图 2 图像预处理 |

首先进行Canny边缘检测,它可以尽可能多地标识边缘,但目标区域的边缘可能会产生断裂。使用形态学中的膨胀操作,使目标图像边缘连通,下一步使用腐蚀操作使边缘细化,最后去掉一些面积较小的连通区域。形态学操作完成后,目标边缘信息被增强,而背景边缘得到了一定的削弱,有利于图像匹配。

3 图像匹配与相似性计算红外目标中包含的角点信息可以准确反映目标特征,为了算法的快速性,只选择其中一个(本文中取左上角)角点作为标志性角点,对可见光边缘图像进行目标提取。目标提取步骤如下:

1) 分别计算最小边缘红外图像和可见光边缘图像的梯度信息;

2) 选择以红外图像左上角角点为中心的4*4区域,提取红外图像标志性角点的梯度信息;

3) 在可见光图像的梯度矩阵B中搜索红外标志性角点的梯度矩阵A,计算误差ε=‖A-B‖,如果查找到匹配信息即误差ε≤10-3,结束搜索;若查找不到即误差ε>10-3,则结果为不匹配。

4) 若查找到匹配信息,以此为起始位置,提取出与红外目标大小相似的区域。因为红外目标与可见光目标拍摄角度及远近的不同,大小可能存在差异,所以提取的目标区域应比红外区域稍大一些,避免因为图像大小差异而造成目标不全。

提取出红外图像与可见光图像的待匹配目标后,本文选择傅里叶描述子作为图像的相似性度量。找到可见光和红外图像的待匹配区域后,用傅里叶描述子表示目标边界。为了便于比较,将傅里叶系数归一化到[0,1]范围内。下一步,逐一比较可见光和红外图像的待匹配边界的傅里叶系数,寻找2幅图像中误差最小的点,认为是匹配点。若匹配点数目与总边界点数目之比大于阈值0.7,则认为可见光图像中包含红外图像边缘,结果为匹配;若小于0.7,则认为不包含红外图像边缘,结果为不匹配。

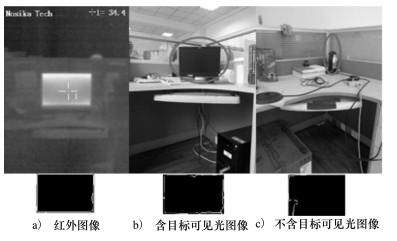

4 实验结果与分析 4.1 显示器的图像匹配实验环境为matlab 2013b。红外图像由HD160型非制冷焦平面热像仪拍摄, 可见光图像由三星手机拍摄。待匹配目标区域为显示器。

|

| 图 3 显示器目标原图及待匹配区域结果图 |

使用边缘和角点相结合的目标提取方法,可以准确提取出含目标的可见光图像的待匹配目标区域,为后面的匹配减少了工作量。而不含目标的可见光图像中提取出的目标部分为图中标注部分,明显与目标不符。

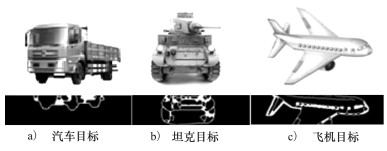

4.2 其他的图像匹配实验中采用汽车、坦克、飞机3类图像数据库,其中每类目标中均含有8幅目标相互匹配的红外与可见光图像和4幅与红外图像不匹配的含有干扰目标的可见光图像,图 4和图 5为数据库中部分图像。

|

| 图 4 数据库中部分图像及待匹配区域提取结果 |

|

| 图 5 部分干扰目标及待匹配区域提取结果 |

从图 4和图 5可以看出,使用本文边缘与角点相结合的目标提取与匹配算法,匹配的可见光图像目标区域提取的都比较准确,基本包含了目标的全部边缘。而干扰目标的提取区域大多不完整,视觉上与红外目标边缘差异巨大。而使用傅里叶描述子进行相似性度量时,以红外图像为参考,仅显示可见光图像是否匹配,实验结果如表 1所示。

可以看出,对于匹配目标与干扰目标,提取目标区域后可以很准确地得到匹配结果。

本文方法从匹配准确率(平均值)、算法耗时2个方面与基于傅里叶描述子和CSS方法进行了对比,具体结果如表 2所示。从表中可以看出,在准确率方面,本文方法均优于基于傅里叶描述子方法与CSS方法,且显示器的匹配率远远超过其他2种方法。在耗时方面,本文方法均优于基于傅里叶描述子方法。除此之外,还将本文方法与SIFT匹配算法进行了对比,结果表明,SIFT算法不适用于本文目标,因为红外图像分辨率过低而且细节过少,SIFT方法寻找到的匹配点非常少而且都是错误匹配。

| 方法 | 匹配准确率% | 算法耗时/s |

| 基于傅里叶描述子 | 68 | 2.368 8 |

| CSS | 74 | 0.332 3 |

| 本文(显示器目标) | 95 | 0.826 5 |

| 本文(其他目标) | 79 | 2.0173 |

本文针对研究目标的特点,采用边缘和角点相结合的方法提取红外图像与可见光图像的待匹配区域,利用傅里叶描述子方法实现图像的相似性度量匹配。实验结果表明,本文方法与基于傅里叶描述子的方法和CSS方法相比,匹配准确率提高,耗时也较少。

| [1] | Jimmy Singla. Technique of Image Registration in Digital Image Processing: a Review[J]. International Journal of Information Technology and Knowledge Management, 2012, 5(2): 239-243. |

| [2] |

许强, 马登武. 傅里叶描述子与角点相结合的形状匹配[J]. 光电工程, 2013, 40(6): 123-128.

Xu Qian, Ma Dengwu. Shape Matching Combining Corner with Fourier Descriptor[J]. Opto-Electronic Engineering, 2013, 40(6): 123-128. (in Chinese) |

| [3] | Wahed M, Eltawel Gh S, Elkarim A Gad. Automatic Image Registration Technique of Remote Sensing Images[J]. International Journal of Advanced Computer Science and Applications, 2013, 4(2): 177-187. |

| [4] |

杨晓敏, 吴炜, 卿粼波, 等. 图像特征点提取及匹配技术[J]. 光学精密工程, 2009, 17(9): 2277-2282.

Yang Xiaomin, Wu Wei, Qing Linbo, et al. Image Feature Extraction and Matching Technology[J]. Optics and Precision Engineering, 2009, 17(9): 2277-2282. (in Chinese) |

| [5] | Nagham M, Chadi F Abou, Kishk S. Wavelet-Based Image Registration Techniques: A Study of Performance[J]. International Journal of Computer Science and Network Security, 2011, 11(2): 188-196. |

| [6] | Zhang Xiaohong, Wang Hongxing, Hong Mingjian, et al. Robust Image Corner Detection Based on Scale Evolution Difference of Planar Curves[J]. Pattern Recognition Letters, 2009, 30(4): 449-455. DOI:10.1016/j.patrec.2008.11.002 |

| [7] | Kokila R, Thangavel P. FFT Based Image Registration Using Corner Response[J]. International Journal of Computer Science and Electronics Engineering, 2013, 1(5): 607-613. |

| [8] |

朱英宏, 李俊山, 汤雨. 基于CSS角点提取的红外与可见光图像匹配算法[J]. 系统工程与电子技术, 2011, 33(11): 2540-2545.

Zhu Yinghong, Li Junshan, Tang Yu. Matching Algorithm for IR/Visible Images Based on CSS Corner Extraction[J]. Systems Engineering and Electronics, 2011, 33(11): 2540-2545. DOI:10.3969/j.issn.1001-506X.2011.11.37 (in Chinese) |

| [9] |

胡敏, 李梅, 汪荣贵. 改进的Otsu算法在图像分割中的应用[J]. 电子测量与仪器学报, 2010, 24(5): 443-449.

Hu Min, Li Mei, Wang Ronggui. Application of an Improved Otsu Algorithm in Image Segmentation[J]. Journal of Electronic Measurement and Instrument, 2010, 24(5): 443-449. (in Chinese) |

2. Xi'an Satellite Control Center, Xi'an 710043, China