多传感器图像融合技术已得到广泛关注, 并成功地应用到许多领域, 如军事侦查、医学诊断、遥感成像和目标检测等。按照不同的波长区域, 频谱可分为:红外、可见光和紫外线3个波段。因此, 不同波段的区域具有不同的成像机理和特性。在实际应用中, IR和VIS图像的融合已成为图像融合领域的研究热点。对IR图像, 在目标场景没有困难和天气条件限制的情况下, 能够识别热或隐藏目标, 但是它对亮度的变化并不敏感, 往往会导致弱的对比度和细节信息的缺乏。与IR图像相比, VIS图像能够提供更高的对比度和更丰富的细节信息, 但在夜间或低光照条件下图像的质量较差。为了获得比任何1幅单一源图像具有更高的准确性、可靠性和更好视觉效果的改进图像,出现了图像融合技术, 并被用于从源图像输入互补和全面的信息到单一的合成图像, 能够显著增强人们对目标场景的理解和分析。

在过去的几十年中, 已提出许多融合方法, 按照融合结果的颜色, 图像融合算法可分为灰度融合和彩色融合。彩色图像比单色图像更有利于监视, 侦察和安全应用。彩色层的区分度大约是灰度层的数百倍, 许多实验结果表明, 彩色融合可以提高特征对比, 更利用于场景分割和目标检。因此, 颜色融合成为越来越重要的研究领域, 提出了许多种彩色图像融合方法[1-4]。

彩色融合的主要课题是彩色一致性。研究结果表明, 缺乏彩色一致性和不合理的颜色映射, 可能会阻碍人类的性能。2001年, Reinhard等人最先根据lαβ颜色空间各分量互相独立的特性, 提出了颜色信息传递技术, 将不同条件下捕获的彩色图像通过两步变换, 在2幅图像之间实现了不同颜色的传递[5]。2002年, Welsh等人提出了在lαβ空间采用单像素点亮度值匹配的方法来实现参考图像(即, 彩色图像)和目标图像(即, 灰度图像)之间颜色的传递[6]。这种传递方法过于简单, 其算法的鲁棒性特别差, 而且算法的复杂度特别高。2003年, Toet最初采用颜色转换技术来实现VIS图像到多波段夜视图像之间的色彩传递[1]。这种方法匹配夜视图像到目标光照彩色图像的一阶统计特性(均值和标准偏差), 使得彩色夜视图像的颜色外观与自然目标图像的颜色相类似。但是, RGB和LMS, LMS和lαβ彩色空间之间的转换采用对数和指数操作会占用太多时间。另外, 这种方法也不能为动态图像提供恒定的颜色。2009年, 国内学者赵源萌等人[2]提出一种单波段IR图像的色彩传递图像融合方法, 但是由于IR图像自身的分辨率较低, 且包含的细节信息并不丰富, 导致融合后图像的视觉效果并不理想。2010年, 李光鑫等人[3]转向研究YCbCr颜色空间的色彩传递, 提出了一种基于YCbCr空间的快速FC图像融合方法。但是, 在色彩传递的途中使用了与文献[1]一样的线性变换, 致使染色后图像目标信息不清楚。为了突出染色后图像中的目标信息, 文献[4]提出了在YUV空间使用NSCT实现IR和VIS图像染色的增强算法。该方法虽然能够增强染色后图像中的目标信息, 但是, 在NSCT域, 由于设计融合规则的缺陷, 导致染色后图像的局部区域出现严重的色彩失真现象。

为此, 本文提出了一种基于NSST变换域KFE与DUM-PCNN的伪彩色图像融合方法。首先, 在NSST域, 采用新设计的KFE取大与DUM-PCNN的融合规则合成F图像, 并用其代替亮度成份Y。然后, 采用IR和VIS图像的差异信息构成伪彩色图像的色度分量U和V。其次, 将参考(REF)图像转换到YUV颜色空间, 对REF图像和FC图像进行色彩信息的传递。最后, 得到和自然图像具有相近的染色图像。实验结果证明, 染色后的F图像获得了更丰富的颜色, 包含更多的细节, 更有利于目标探测和大范围的场景理解。

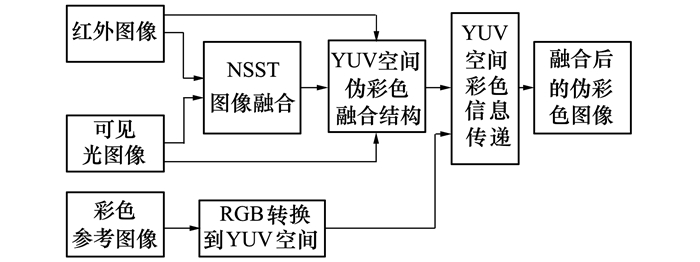

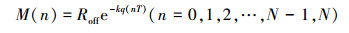

1 夜视伪彩色图像的融合方案本文提出的基于NSST变换域的FC图像融合的原理框图如图 1所示。

|

| 图 1 基于NSST的假彩色图像融合的原理框图 |

在NSST变换域, 采用KFE和DUM-PCNN的融合规则得到IR与VIS融合图像, 并采用线性映射技术将获得的F图像与IR, VIS图像进行组合将其转换至YUV空间, 即能够得到YUV彩色空间的FC图像。利用颜色信息传递技术, 将彩色REF图像的色彩信息传递给采用上述方法获得的FC图像, 即将REF图像由RGB颜色空间转换至YUV颜色空间, 然后在YUV空间进行色彩信息的传递。最后, 将其由YUV空间转换至RGB空间, 即可获得染色后的FC图像。

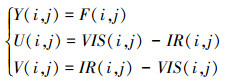

采用YUV颜色空间构造的FC图像可以表示如下

|

(1) |

式中, VIS(i, j)和IR(i, j)分别为VIS和IR图像在位置(i, j)处图像像素的灰度值。F(i, j)为基于NSST的IR、VIS融合图像。利用本文提出的融合规则, 可以有效的将IR与VIS图像之间的互动信息得到更好的保留, 增强人类视觉系统对图像场景的理解, 提高后续对目标的探测率。

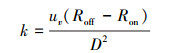

2 基于NSST变换域KFE与DUM-PCNN的红外与可见光融合 2.1 双通道单连接记忆性PCNN模型与原始的PCNN一样, DUM-PCNN被构造如图 1所示, 它主要由4部分构成:接收部分、调制部分、阈值产生部分和脉冲产生部分。

本文构造的DUM-PCNN与PCNN和DUL-PCNN模型有所不同, 即, 在脉冲的产生部分采用了记忆性元件, 它能记住当前状态的变化, 具有自适应调整阈值的特性。现对DUM-PCNN的各部分功能进行详细介绍。

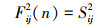

接收部分由两部分输入信号组成。第一部分输入是来自其他神经元Y的输出。另外一部分输入是来自2幅图像Sij1和Sij2的外部激励, 其数学表达式如下:

|

(2) |

|

(3) |

式中,(i, j)为对应图像像素的灰度值。

在DUM-PCNN模型中, 本文构造的调制部分可用方程(4) 表示。和PCNN模型一样, Uij为神经元的内部状态, 并且每个神经元的输出能够表示如下:

|

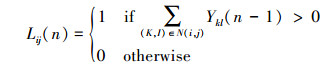

(4) |

Lij(n)为连接输入。不同于PCNN和DUL-PCNN模型, 构造的DUM-PCNN模型能够提高每一通道的连接强度。只要通道Lij(n)的值为1, 在它的区域周围就存在区域点火神经(不包括中心神经元本身), 并且其他的值将被设置为0。很明显, 这使得DUM-PCNN容易分析和控制。Lij(n)的数学方程可以表示如下

|

(5) |

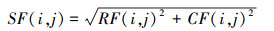

参数βij1和βij2为连接强度, 它反映了像素的特性并且在内部活动范围内能自适应调整连接通道的权值, 因此, 它在图像融合的方法中起着重要的作用。大多数文献通过实验或经验分配恒定的常数, 如0.2[8]。在PCNN模型中, 这种设置方式可以大大简化问题, 但是它并没有考虑图像的实际。文献[7]提出了基于平均梯度的指数延时, 它能够提高F图像的质量。然而, 由于采用了一种新的指数函数并且它的值取决于像素的灰度值。这种方法计算起来时间复杂度较高。图像的空间频率反映了人类视觉系统的基本特性, 能够表示图像的整体活跃程度。因此, 本文提出一种区域空间频率(LSF)的方法, 并取得好的结果, 它能够被描述为方程(6)~(8), 其中, r=2, I(i, j)为局部区域的图像灰度值, RF(i, j)和CF(i, j)分别表示行频和列频。总的LSF可以由方程(6) 计算得出。

|

(6) |

式中, RF(i, j)和CF(i, j)分别由方程(6) 和(7) 给出。

|

(7) |

|

(8) |

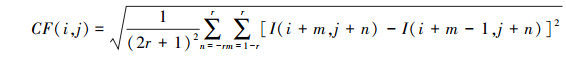

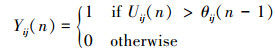

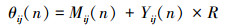

DUM-PCNN中的脉冲产生部分可以用方程(9) 来描述。和DUL-PCNN模型一样, Yij(n)为激活函数, 它控制神经元的输出其数学表达式为

|

(9) |

θij(n)为DUM-PCNN中的阈值函数, 它可用方程(10) 来描述阈值的变化。与PCNN和DUL-PCNN模型有所不同的是,本文提出的阈值函数由具有记忆性的元器件构成。它能够减少PCNN模型在电路实现过程中所需元器件的数量, 并克服PCNN的不足[9]; 另外它还能记住当前时刻阈值的变化, 并且能够自适应地调整任意时刻的阈值。其数学定义式可由方程(10)~(13) 给出。

|

(10) |

|

(11) |

|

(12) |

|

(13) |

式中, Ron、Roff分别为最大和最小的记忆性电阻。D为薄膜的厚度, Mij和R分别为记忆性电阻和普通电阻, T为样本周期, I为直流电流, uv为电压。

|

| 图 2 DUM-PCNN模型 |

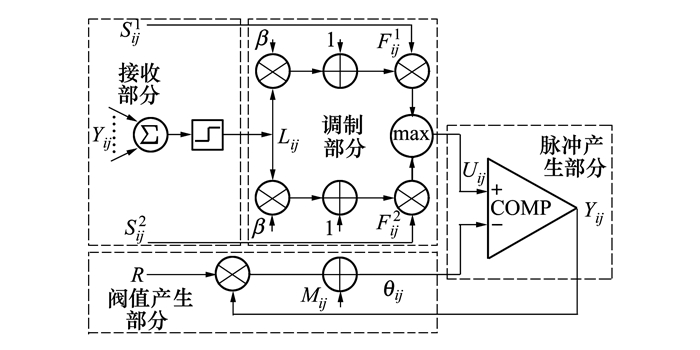

低频子带主要反映了原图像的近似分量同时也包含了少量的细节信息。在选用较少的分解层数时, 图像的细节信息显得尤为突出。目前, 最流行的方法是采用平均法产生复合系数。然而, 这种方法在融合过程中由于忽略了VIS图像的边缘细节和光谱信息, 导致融合图像对比度的减少, 图像边缘的模糊。Kirsch等人[10]提出了一种有效的边缘检测方案。该方案可以有效检测图像的边缘。受该方案的启发, 本文提出了一种新的特征(称为KFE)用来表示IR和VIS图像各子带系数的特征, 并将该特征的定义式给出如下

|

(14) |

式中, Z表示IR或VIS图像在NSST域的子带系数, (i, j)为子带系数在图像中的像素位置, “*”表示卷积操作

|

KFE能够从8个不同的方向捕获图像的边缘细节信息。在低频子带IR、VIS图像的融合中, 本文采用方程(14) 计算低频子带IR和VIS图像的KFE并采用KFE取大的融合方案选取低频融合系数。这种方案选取的融合系数能够获得更丰富的细节信息。

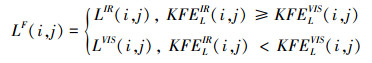

低频IR与VIS子带融合系数的选择方式可以表示如下

|

(15) |

式中, LF表示融合后的低频子带系数, KFELIR和KFELVIS分别表示IR和VIS图像低频系数的KFE。

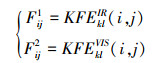

2.2.2 高频子带融合高频子带包含有大量的细节信息如边缘, 线和轮廓。典型的融合规则是选择绝对值最大的方案, 但是原图像之间的冗余信息容易丢失并且将一些振铃效应引入到了融合图像中。在本文中, 提出了一种DUM-PCNN的融合规则融合高频子带, 将2.2.1部分提出的KFE作为DUM-PCNN的外部激励。高频子带的具体融合过程被描述如下:

Step 1 初始化Uij(0)=Yij(0)=0, 同时, 每个神经元没有点火。根据方程(6), 取每个像素的LSF值作为连接强度。

Step 2 计算高频子带系数的KFE并取它作为喂养通道的输入去激励DUM-PCNN。

|

(16) |

式中, KFEklm (m=IR, VIS)表示在l尺度k方向高频系数的KFE。

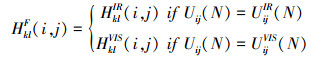

Step 3 按照方程(4, 5, 10, 11, 12, 13) 分别计算Lij、Uij、θij和Yij直到所有神经被激活。融合系数能够被选择如下

|

(17) |

且

|

(18) |

|

(19) |

式中, HklF(i, j)为F图像高频系数。并且UijIR(N)和UijVIS(N)代表IR和VIS图像的内部状态。N表示总共点火次数。

2.2.3 低频子带融合最后, 对得到LF和HklF执行逆NSST变换获得F图像。

3 基于YUV空间的色彩传递本文首先利用第2部分提供的融合方案合成灰度F图像。然后在根据方程(1) 提供的映射方案在YUV空间进行线性映射, 得到FC图像。再采用文献[5]给出的颜色统计转换技术对FC图像进行染色, 最后能够获得和自然图像具有相似外观的染色图像。实现的详细过程给出如下。

选定1幅和VIS图像具有相似场景外观的彩色REF图像, 并采用颜色转换方法将REF图像从RGB颜色空间转换到YUV颜色空间, 分别计算出REF图像在Y、U和V 3个通道对应的均值(MV)和标准差(STD)。为了取得和自然REF图像相似的自然效果, 需采用方程(20) 对REF图像和FC图像在Y、U、V通道进行调整, 使REF图像和FC图像在YUV各通道的MV和STD相一致, 即

|

(20) |

式中, 下角标R、S和F分别为REF图像, 假彩色融合图像和最终的融合图像。μ和δ分别为通道Y、U、V的MV和STD。通过方程(20) 利用线性映射到假彩色融合图像的每一个通道。最终得到的F图像将具有和REF图像一样的外观。

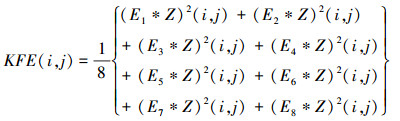

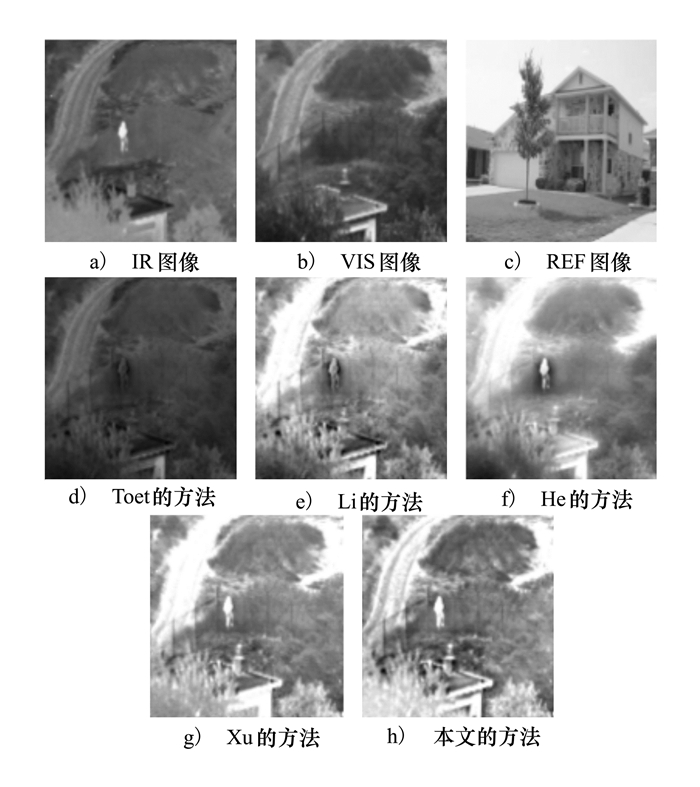

4 实验结果和分析 4.1 实验建立为了验证提出方法的优越性和有效性, 本文将一组IR、VIS图像(如, “Uncamp”)及不同场景的REF图像用于图像融合中.另外, 选择了Toet[1]、Li[3]、He[4]和Xu [11]4种当前主流的彩色融合方法与提出方法进行比较。4种主流对比方法的参数设置与其相应的参考文献相一致。而本文算法的参数设置如下:NSST变换取4层分解, 每一层的方向分解数为[8,8,16,16]。

DUM-PCNN的参设置为:Ron=100 Ω, T=0.001 s, Roff=2 100 Ω, uv=1×10-14 m2s-1v-1, D=1×10-8 m, I=1×10-3 A, R=20 Ω, N=200, 连接权值矩阵W=[1, 1, 1;1, 0, 1;1, 1, 1], 在计算LSF时, 窗的大小设置为3×3。所有实验都是在matlab2015a内i5/3.2GHz/4G的PC机上完成。由于目前对伪彩色融合的客观评价没有统一的特定指标, 所以本文只能从主观视觉分析方面来评价推荐算法的优越性。

4.2 主观分析在“Uncamp”图像集中, IR图像的热目标信息(如人)显示的特别清楚(见图 3a)), 而其他的背景信息确比较模糊, 相反, VIS图像的背景信息如树木、小路和栅栏的轮廓信息表示很清楚(见图 3b)), 而目标信息确丢失。REF图像(见图 3c))的背景与VIS图像背景相似。基于5种融合方案的不同融合效果如图 3d)~图 3h)所示。图 3d)提供的结果色彩信息过于饱和, 导致原图像的一些显著信息如栅栏、树的纹理等被隐藏。图 3e)~图 3f)给出的融合结果中, 图像的亮度信息相比于前一种方法有所提高, 但是局部区域存在丢失信息现象, 色彩失真比较严重。在图 3g)中, 热目标信息(如人)显示的比较清楚, 色彩信息有所提高, 但是在局部区域(如小路)失真比较严重。本文方法(见图 3h))提供的结果中热目标信息突出, 局部区域丢失信息减少, 色彩信息显示的更加自然。

|

| 图 3 “Uncamp”图像集的对比融合结果 |

为了提供丰富的细节信息, 增强融合图像的色彩化显示, 本文提出了一种基于NSST变换域YUV空间的FC图像融合方法。首先, 采用KFE与DUM-PCNN的融合方案, 在NSST域有效地融合IR与VIS图像。随后, 用融合后的图像替换YUV空间的亮度分量Y, 在结合IR图像与VIS图像或(VIS图像与IR图像)之间的差异信息, 分别构成色度分量U(或V)。最后, 结合REF图像提供的信息在YUV彩色空间利用一阶统计学的方法进行色彩信息的传递, 并获得最终的FC图像。为了验证提出算法的有效性, 本文用一组IR、VIS和REF图像进行了仿真实验。实验结果显示, 文中方法得到的F图像细节信息比较丰富, 目标信息更突出, 并且显示的效果更加自然。

| [1] | Toet A. Natural Colour Mapping for Multiband Nightvision Imagery[J]. Information fusion, 2003, 4(3): 155-166. DOI:10.1016/S1566-2535(03)00038-1 |

| [2] | Zhao Yuanmeng, Wang Lingxue, Jin Weiqi, et al. Single-Band Infrared Image Colorization Algorithm Based on Color Transfer[J]. Acta Optica Sinica, 2009, 29(3): 654-658. DOI:10.3788/AOS |

| [3] | Li G X, Xu S Y, Zhao Y L, et al. Fast Color Image Fusion Based on Color Transfer Technique[J]. Optics and Precision Engineering, 2010, 18(7): 1637-1647. |

| [4] | He W H, Guo Y C, Cao C, et al. A Novel Color Fusion Method for Night Vision Image Enhancement Using NSCT[J]. Journal of Computer-Aided Design & Computer Graphics, 2011, 23(5): 884-890. |

| [5] | Reinhard E, Adhikhmin M, Gooch B, et al. Color Transfer between Images[J]. IEEE Computer Graphics and Applications, 2001, 21(5): 34-41. |

| [6] | Welsh T, Ashikhmin M, Mueller M. Transferring Color to Grayscale Images[J]. ACM Trans on Graphics, 2002, 21(3): 277-280. |

| [7] | Xiang T, Yan L, Gao R. A Fusion Algorithm for Infrared and Visible Images Based on Adaptive Dual-Channel Unit-Linking Pcnn in Nsct Domain[J]. Infrared Physics & Technology, 2015, 6(9): 53-61. |

| [8] | Das S, Kundu M K. NSCT-Based Multimodal Medical Image Fusion Using Pulse-Coupled Neural Network and Modified Spatial Frequency[J]. Medical & Biological Engineering & Computing, 2012, 50(10): 1105-1114. |

| [9] | Zhu S, Wang L, Duan S. Memristive Pulse Coupled Neural Network with Applications in Medical Image Processing[J]. Neurocomputing, 2016, 227(1): 149-157. |

| [10] | Kirsch R A. Computer Determination of the Constituent Structure of Biological Images[J]. Computers and Biomedical Research, 1971, 4(3): 315-328. DOI:10.1016/0010-4809(71)90034-6 |

| [11] | Tingfa X, Juntao L, Yizhou Z. True Color Transfer for Dual Band Image Fusion[J]. Chinese Optics, 2012, 7(3): 403-410. |