2. 西北工业大学 保密处, 陕西 西安 710072;

3. 西北工业大学 计算机学院, 陕西 西安 710072

在过去十年中, 可见光和红外图像的图像融合已成为图像处理领域的热点研究课题[1]。由于可见光和红外图像传感器的特性不同, 且来自同一场景的可见光和红外图像之间存在信息互补和冗余, 因此融合图像能够提供关于场景的更全面信息, 并且比其中任何一种源图像更适合于后续处理任务。当然融合结果必须满足以下要求[2]:① 融合算法应该尽可能包括源图像的所有有用信息。② 融合算法不应该产生误导后续图像处理和目标识别的虚假信息。③ 融合算法应该具有良好的稳定性、鲁棒性, 并且最好具备一定的去噪和消除配准误差的容错能力。

近年来, 继小波变换[3]之后, 多尺度分析和压缩感知成为研究的热点, 其近乎完美的性能使其在图像融合领域得到了广泛的应用并表现出了优良的性能。例如Ridgelet变换[4]、Contourlet变换[5]的融合算法能克服小波变换的尺度单一, 但是不能最优表示线奇异性; NSCT变换[6]的融合算法能克服Contourlet变换由于上采样的不足, 但计算复杂度高; Shearlet变换[7]的融合算法计算复杂度低, 但是下采样容易造成信息混叠; 相比以上变换, NSST[8]变换的融合算法能克服其不足, 计算复杂度更低, 逆变换只需对剪切滤波器进行合成, 而不必像Contourlet变换那样将方向滤波器组进行逆合成, 因此本文NSST域的融合算法进行了研究。

由于多尺度分析要对图像进行分解和合成, 因此容易造成信息丢失, 而基于字典的学习算法能克服其不足, 故其一直备受国内外学者亲睐, 是当前国际研究的热点之一。字典学习通常具有显式的矩阵表达, 从而在图像融合领域得到了应用。文献[9-10]提出了小波域, Contourlet域字典的学习算法, 但是计算比较复杂, 文献[11]提出了聚类的字典学习算法, 文献[12]提出了特征字典学习的融合算法, 这些算法虽然能精细图像的表示, 稀疏编码的拟合数据, 但是这种非结构化的字典计算代价太高, 原子的大小也限制了其应用。文献[13-14]提出了压缩感知的融合算法, 文献[15]提出了基于多分辨率分析和字典学习的融合算法, 但是该算法融合图像容易出现大块噪声, 而且边缘有振铃现象。

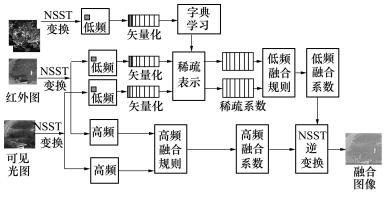

基于以上分析, 本文提出了一种基于NSST和字典学习的红外和见光图像融合算法。对红外和可见光图像进行NSST分解, 在低频系数上利用滑动窗口得到图像块序列, 并对其进行零均值化后再稀疏分解, 选择区域能量的融合规则; 在高频子带系数上, 选择拉普拉斯能量和的融合规则, 仿真结果表明, 本文的算法在视觉和客观评价指标上优于其他融合算法。

1 稀疏表示和字典训练1.1 稀疏表示稀疏表示以压缩感知(compressed sensing, CS)理论为基础, 寻找信号在一组字典下的最稀疏表示。稀疏性意味着仅需要少量的原子来充分重建信号, 即系数变得稀疏。图像的稀疏模型要求将图像表示为一组字典中少数几个典型原子的线性组合, 基本思想是假设自然信号能由字典中“少量”原子的线性组合表示或近似表示。过完备性意味着字典中的原子数目大于信号的维数。因此, 在过完备字典中足够数量的原子允许更灵活和有意义的信号表示。

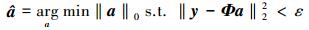

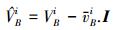

让y∈Rn表示图像信号向量, Φ∈Rn×m是一个完整的字典, 其列向量是它的原子。根据稀疏表示理论, 图像信号向量可以表示为这些原子的线性组合, 即, y=Φa, 其中a∈Rm是稀疏系数向量(n < m)。稀疏系数向量可以通过求解以下优化问题找到

|

(1) |

式中,‖a‖0表示a中非零项的计数, ε是有界表示误差。上述方程的求解是一个NP难问题, 目前常用的方法有:BP算法、MP算法、OMP算法等。其中, OMP算法克服了BP算法计算复杂度高和MP算法迭代次数多的问题, 是目前应用最广泛的稀疏分解方法。

1.2 字典训练过完备字典的选取决定了信号稀疏编码的能力, 在稀疏表示中起关键性作用。稀疏字典的构造主要有分析模型和机器学习2种方法。分析模型学习到的字典没有明确的矩阵形式, 但是具有快速方法和高度结构化的构架, 并且大多数字典可以多尺度地分析图像。机器学习模型学习到的字典通常具有具体的矩阵表达, 并且能更精细地拟合数据, 从而在许多应用中性能更好。但是这种非结构化的字典计算代价高, 原子的大小也限制了这种字典的应用。典型学习方法有PCA、MOD和K-SVD方法。

K-SVD是一个用于稀疏表示的字典学习算法, 是一个迭代算法, 是K-Means算法的泛化。由于输入图像块是通过所提出的信息采样得到的, 且每个训练子字典非常紧凑且均包含来自图像的信息成分, 因此子字典学习方案可以获得输入图像块更准确的结构描述。

2 图像融合算法在NSST域基于稀疏字典的可见光和红外图像的融合算法如图 1所示。

|

| 图 1 本文算法流程图 |

NSST是一种非正交变换, 由非下采样得拉普拉斯金字塔变换和剪切波滤波器组组合实现。首先, 对可见光和红外图像进行非下采样金字塔滤波器进行多尺度分解; 然后用剪切波滤波器将分解结果从伪极化网格系统映射到笛卡尔坐标系统, 再利用傅里叶变换直接通过二维卷积完成滤波, 这样做避免了下采样操作造成的混叠, 使NSST分解具有平移不变性。变换后各尺度上各方向子带的大小都与原图像相同, 图像的冗余度得到了很大的提高

可见光和红外图像经过NSST分解后, 各得到一个相应的低频系数和多个高频系数。

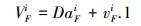

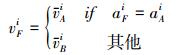

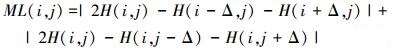

2.2 低频系数基于稀疏字典的快速融合算法1) 利用滑动窗口把红外和可见光图像的低频系数CLA、CLB从坐上到右下依次划分为大小为

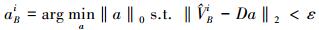

2) 重新排列系数模块PAi、PBi且转换为列向量VAi、VBi, 归一化处理变为

|

(2) |

|

(3) |

3) 利用OMP算法计算

|

(4) |

|

(5) |

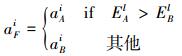

4) 运用融合规则, 融合aAi和aBi生成融合稀疏系数

对于稀疏系数融合规则的选择, 目前大部分文献选用最大值法则, 因为图像的低频系数集中了图像的绝大部分能量, 反映了图像块的亮度, 高频系数代表了图像的细节、边缘, 反映了图像块的纹理特性, 但是这种选择方法分不清噪声和图像信息, 从而影响了融合图像的清晰度和信息熵, 降低了图像对比度。同时实验发现, NSST分解后的系数经OMP变换后的系数仍然带有区域性质, 因此本文提出一种新的基于区域能量的融合规则。令EAl和EBl表示aAi和aBi的S区域内积, 则融合稀疏系数aFi可以通过比较EAl和EBl求得

|

(6) |

|

(7) |

|

(8) |

融合的系数矢量可以表示为

|

(9) |

上式中融合的均值为

|

(10) |

5) 对

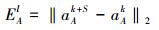

高频子带融合的目标是提取源图像中的边缘结构, 系数绝对值取大融合准则可以获得高频子带图像中丰富的边缘信息, 但容易造成图像的不连续性。局部区域平均能量取大融合准则能够降低噪声的敏感性, 但容易使目标轮廓与非轮廓区域之间模糊。整合上述2种融合准则的优点, 设计一种系数绝对值与邻域平均能量一致性选择与加权相结合的融合准则, 在降低噪声敏感性的同时, 最大限度地提取源图像中边缘细节和亮度信息, 提高融合图像的清晰度, 显得尤为重要。

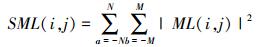

由于NSST变换的各个方向带通子带是图像的细节信息, 而拉普拉斯能量和可以很好地反映图像的边缘特征信息, 在一定程度上可以恰当地表征图像的聚焦特性和清晰度, 文献[2]利用拉普拉斯能量和进行图像融合取得了较好的效果.为了获得视觉特效更好、细节信息更加丰富的融合图像, 本文提出了一种通过比较高频子带拉普拉斯能量和的融合算法, 对于方向带通子带的拉普拉斯能量和定义为

|

(11) |

|

(12) |

通过比较高频子带拉普拉斯能量和, 来确定融合后的高频子带系数

|

(13) |

对低频融合系数和高频子带融合系数进行NSST逆变换得到最终的融合图像。

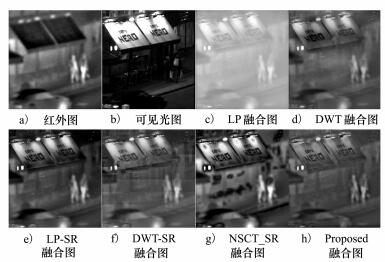

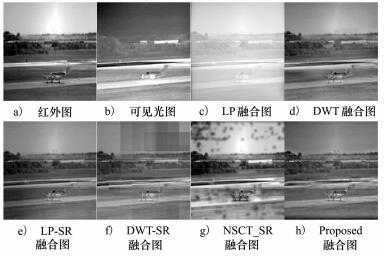

3 实验结果及其分析为了检验本文提出的融合算法, 我们选用了若干数据进行了实验并选取“airport”和“street”2种数据做说明, 图像大小均为256*256。5类比较算法包括:基于拉普拉斯金字塔变换的融合算法(LP)、基于小波变换的融合算法(DWT)、基于拉普拉斯金字塔变换和稀疏表示的融合算法(LP-SR)[15]、基于小波变换和稀疏表示的融合算法(DWT-SR)[15]、基于非下采样轮廓波变换和稀疏表示的融合算法(NSCT_SR)[15]。其中LP和DWT采用低频系数取平均, 高频子带系数取绝对值最大的融合规则。本文中NSST的分解尺度为4, 方向分解依次为3、3、4、4, 稀疏表示的字典大小为64×256, ε=0.1, 滑动窗口大小为8×8。

定量评价指标选用图像相关系数CC、图像差异的相关性之和SCD[16]和平均结构相似度SSIM[17]。CC和SCD反映变量之间相关关系密切程度, SSIM衡量2幅图像结构相似度的新指标。一般说来, 其值越大表明融合图像的质量越好。

实验结果如图 2和图 3所示, 可以看出LP算法好像蒙上了一层薄纱, DWT算法比较简单, 计算量小, 但细节不够清晰, DWT-SR好像人为分段结果, NSCT_SR有斑块噪声, LP-SR有边缘噪声。与其他算法相比, 本文算法能有效去除噪声, 且不存在斑块噪声。表 1是融合结果的客观指标, 最优指标采用加粗表明。可以看出, 本文提出的融合算法性总体上优于其他算法。

|

| 图 2 第一组红外与可见光融合图像 |

|

| 图 3 第二组红外与可见光融合图像 |

| dataset | method | DWT | LP | LP-SR | DWT-SR | NSCT-SR | Proposed |

| airport | CC | 0.440 | 0.345 | 0.395 | 0.395 | 0.425 | 0.425 |

| SCD | 1.62 | 1.39 | 1.61 | 1.52 | 1.57 | 1.62 | |

| SSIM | 0.665 | 0.625 | 0.680 | 0.595 | 0.560 | 0.680 | |

| street | CC | 0.505 | 0.500 | 0.480 | 0.420 | 0.485 | 0.530 |

| SCD | 1.64 | 1.65 | 1.65 | 1.51 | 1.68 | 1.77 | |

| SSIM | 0.525 | 0.525 | 0.570 | 0.520 | 0.510 | 0.570 |

本文针对红外和可见光图像融合结果的大块噪声, 边缘振铃现象, 感兴趣目标不突出等不足, 提出了一种基于NSST和字典学习的红外和见光图像融合算法。首先对源图像经NSST变换后的低频系数上进行稀疏表示, 提取源图像的显著特征; 同时, 利用滑动窗口把低频系数分解成图像块序列, 对其零均值化后再稀疏表示, 选择区域能量的融合规则; 对于高频子带系数, 选择拉普拉斯能量和的融合规则。实验结果表明, 该方法在主观视觉效果、客观指标评价都优于其他算法。

| [1] | Zhang X Q, Chen Q L, Men T. Comparison of Fusion Methods for the Infrared and Color Visible Images[C]//Second IEEE International Conference on Computer Science and Information Technology, Beijing, 2009:421-424 |

| [2] | Gan Wei, Wu Xiaohong. Infrared and Visible Image Fusion with the Use of Multi-Scale Edge-Preserving Decomposition and Guided Image Filter[J]. Infrared Physics & Technology, 2015, 72: 37-51. |

| [3] | Li Xu, He Mingyi, Michel ROUX. Multifocus Image Fusion Based on Redundant Wavelet Transform[J]. IET Image Processing, 2010, 4(4): 283-293. DOI:10.1049/iet-ipr.2008.0259 |

| [4] |

李晖晖, 郭雷, 李国新. 基于脊波变换的SAR与可见光图像融合研究[J]. 西北工业大学学报, 2006, 24(4): 418-420.

Li Huihui, Guo Lei, Li Guoxin. Is Ridgelet Transform Better than Wavelet Transform in SAR and Optical Image Fusion[J]. Journal of Northwestern Polytechnical University, 2006, 24(4): 418-420. (in Chinese) |

| [5] | Yang Shuyuan, Wang Min, Jiao Licheng, et al. Image Fusion Based on a New Contourlet Packet[J]. Information Fusion, 2010, 11(2): 78-84. DOI:10.1016/j.inffus.2009.05.001 |

| [6] | Zhang Qiong, An X M. Adaptive Fusion Approach for Infrared and Visible Images Based on NSCT and Compressed Sensing[J]. Infrared Physics & Technology, 2016, 79: 11-20. |

| [7] | Yin Ming, Duan Puhong, Liu Wei, et al. A Novel Infrared and Visible Image Fusion Algorithm Based on Shift-Invariant Dual-Tree Complex Shearlet Transform and Sparse Representation[J]. Neurocomputing, 2017, 226(22): 182-191. |

| [8] | Liu Zhanwen, Feng Yan, Zhang Yifan, Li Xu. A Fusion Algorithm for Infrared and Visible Images Based on Rdu-Pcnn and Ica-Bases in Nsst Domain[J]. Infrared Physics & Technology, 2016, 79: 183-190. |

| [9] |

王珺, 彭进业, 何贵青, 冯晓毅. 基于多尺度字典学习的图像融合方法[J]. 西北工业大学学报, 2013, 31(5): 743-797.

Wang Jun, Peng Jinye, He Guiqing, Feng Xiaoyi. An Image Fusion Algorithm Based on Multi-Scale Dictionary Learning[J]. Journal of Northwestern Polytechnical University, 2013, 31(5): 743-797. (in Chinese) |

| [10] |

王珺, 彭进业, 何贵青, 等. 基于非下采样Contourlet变换和稀疏表示的红外与可见光图像融合方法[J]. 兵工学报, 2013, 34(7): 815-820.

Wang Jun, Peng Jinye, He Guiqing, et al. Fusion Method for Visible and Infrared Images Based on Non-Subsampled Contourlet Transform and Sparse Representation[J]. Acta Armamentarii, 2013, 34(7): 815-820. (in Chinese) |

| [11] | Kim Minjae, Han David K, Ko Hanseok. Joint Patch Clustering-Based Dictionary Learning for Multimodal Image Fusion[J]. Information Fusion, 2016, 27: 198-214. DOI:10.1016/j.inffus.2015.03.003 |

| [12] | Mansour Nejati, Shadrokh Samavi, Shirani Shahram. Multi-Focus Image Fusion Using Dictionary-Based Sparse Representation[J]. Information Fusion, 2015, 25: 72-84. DOI:10.1016/j.inffus.2014.10.004 |

| [13] |

李晖晖, 曾艳, 杨宁, 等. 改进的压缩感知重构算法及其在图像融合中的应用[J]. 南京理工大学学报, 2014, 38(02): 259-263.

Li Huihui, Zeng Yan, Yang Ning, et al. Improved Compressed Sensing Reconstruction Algorithm and Its Application in Image fusion[J]. Journal of Nanjing University of Science and Technology, 2014, 38(02): 259-263. DOI:10.3969/j.issn.1005-9830.2014.02.013 (in Chinese) |

| [14] |

杨森林, 万国宾. 基于分块压缩感知的遥感图像多尺度融合[J]. 西北大学学报, 2015, 45(3): 399-404.

Yang Senlin, Wan Guobin. Multi-Scale Fusion for Remote-Sensing Images by Block-Based Compressed Sensing[J]. Journal of Northwest University, 2015, 45(3): 399-404. (in Chinese) |

| [15] | Yu Liu, Shuping Liu, Wang Zengfu. General Framework for Image Fusion Based on Multi-scale Transform and Sparse Representation[J]. Information Fusion, 2015, 24: 147-164. DOI:10.1016/j.inffus.2014.09.004 |

| [16] | Aslantas V, Bendes E. A New Image Quality Metric for Image Fusion:the Sum of the Correlations of Differences[J]. Int J Electron Commun, 2015, 69: 1890-1896. DOI:10.1016/j.aeue.2015.09.004 |

| [17] | Wang Zhou, Bovik Alanconrad, Hamid Rahimsheikh, et al. Image Quality Assessment:from Error Visibility to Structural Similarity[J]. IEEE Trans on Image Processing, 2004, 13(4): 600-612. DOI:10.1109/TIP.2003.819861 |

2. Divison for the Protection of State Secrets, Northwestern Polytechnical University Xi'an 710072, China;

3. School of computer, Northwestern Polytechnical University Xi'an 710072, China